Cómo redactar contratos responsablemente con asistencia de IA

Equipos legales en todo el país están descubriendo una verdad incómoda: la redacción de contratos asistida por IA puede reducir horas de trabajo a minutos, pero un único resultado no verificado puede introducir errores que sobreviven hasta la ejecución. Un equipo interno recientemente confió en una herramienta de IA para generar un acuerdo de proveedor, solo para descubrir que la cláusula de indemnización citaba un estatuto que no existía. La cláusula pasó dos revisiones internas antes de que un socio la detectara. Ese escenario no es una excepción. Es una vista previa de lo que sucede cuando la velocidad supera el proceso.

Tabla de contenidos

- Entender tus obligaciones: competencia, confidencialidad y supervisión

- Preparación: construir un flujo de trabajo para redacción responsable de contratos con IA

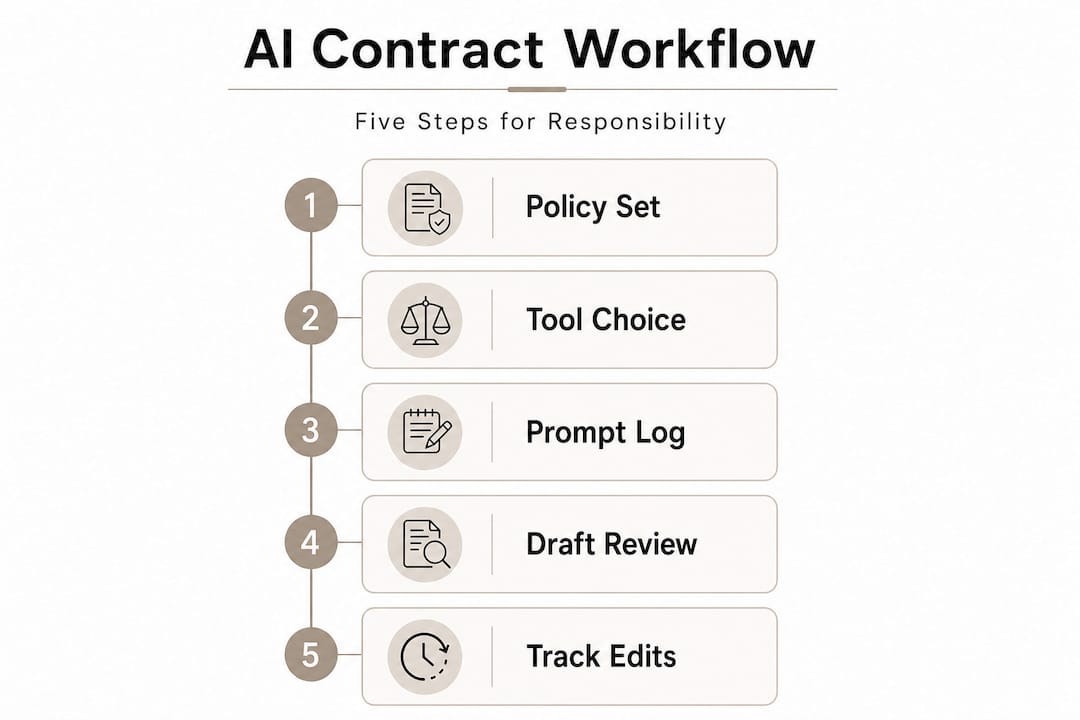

- El proceso de redacción de contratos: integración responsable de IA paso a paso

- Solución de problemas y mitigación de riesgos comunes: alucinaciones, casos extremos y fallos de cumplimiento

- Por qué tratar la IA como asistente, no como oráculo, cambia los resultados

- Explora flujos de trabajo responsables de redacción de contratos vinculados a fuentes

- Preguntas frecuentes

Puntos clave

| Punto | Detalles | | --- | --- | | La verificación humana es esencial | Siempre trata los borradores generados por IA como no verificados hasta que un experto legal los revise exhaustivamente. | | Comprende las obligaciones legales | Los abogados deben aplicar competencia, confidencialidad y supervisión al integrar herramientas de IA. | | Audita y documenta flujos de trabajo | Mantén registros trazables de indicaciones de IA, revisores y cambios de contratos para cumplimiento y defensa. | | Enfócate en puntos de fallo comunes | Concentra la revisión en citas, estatutos, cláusulas jurisdiccionales y posibles alucinaciones. | | Contratos estructurados con proveedores de IA | Rige contractualmente el uso de datos, riesgo y derechos de auditoría al usar herramientas de IA de terceros. |

Entender tus obligaciones: competencia, confidencialidad y supervisión

Antes de que cualquier herramienta de IA toque un contrato, los profesionales legales deben ser claros sobre lo que la responsabilidad profesional realmente requiere. Las reglas no han sido reescritas para la IA. Han sido aplicadas a ella.

ABA Formal Opinion 512 enmarca la IA generativa como una tecnología que los abogados deben usar competentemente bajo deberes existentes, incluyendo confidencialidad, supervisión y verificación del producto de trabajo. Ese marco importa. Significa que el abogado que ejecuta una indicación y pega el resultado en un borrador de contrato sigue siendo el profesional responsable de cada palabra en ese documento.

Los deberes principales que se aplican al usar IA en redacción de contratos incluyen:

- Competencia: Debes entender lo suficiente sobre cómo funciona la herramienta de IA para identificar cuándo es probable que falle, no solo cuándo tiene éxito.

- Confidencialidad: Los datos del cliente cargados en una plataforma de IA de terceros pueden ser retenidos, utilizados para entrenamiento de modelos o expuestos a brechas. El deber de confidencialidad requiere que entiendas esos riesgos antes de ingresar nada.

- Supervisión: Si un asociado junior o asistente legal ejecuta borradores asistidos por IA, el abogado supervisor es responsable del resultado como si lo hubiera escrito personalmente.

- Verificación: El texto generado por IA es un borrador no verificado. Punto. Debe ser tratado de esa manera en cada etapa.

"Los abogados siguen siendo responsables de todo producto de trabajo, independientemente de la herramienta utilizada para generarlo. La IA generativa no transfiere ni diluye la responsabilidad profesional."

Comenzar con una política interna de firma que codifique estos deberes en tu flujo de trabajo no es opcional. Es la base. Las plataformas construidas alrededor de principios de redacción de IA pueden ayudar a los equipos a operacionalizar estas obligaciones en lugar de dejarlas como recordatorios abstractos en una lista de verificación de cumplimiento.

Preparación: construir un flujo de trabajo para redacción responsable de contratos con IA

Conocer tus obligaciones es el punto de partida. Construir un flujo de trabajo que realmente las haga cumplir es el trabajo más difícil. La mayoría de los equipos que tienen problemas con la redacción asistida por IA no fallan porque ignoraron las reglas de ética. Fallan porque nunca tradujeron esas reglas en pasos de proceso concretos.

Un flujo de trabajo responsable de redacción de contratos debe operacionalizar puertas de revisión: tratar el texto de IA como borradores no verificados y requerir verificación humana antes de la liberación o confianza. Eso no es una sugerencia. Es el estándar mínimo para práctica defendible.

Antes de que tu equipo redacte un único contrato asistido por IA, trabaja a través de esta lista de verificación de preparación:

- Capa de política: Redacta y adopta una política interna de uso de IA que especifique qué herramientas están aprobadas, qué datos se pueden compartir y quién está autorizado para usar IA para qué tareas.

- Selección de herramientas: Elige plataformas que ofrezcan seguimiento de fuentes, registros de auditoría, controles de acceso y políticas claras de retención de datos. Evita herramientas que no puedan decirte de dónde vino una cláusula.

- Acuerdos con proveedores: El uso responsable puede incluir contratación estructurada de proveedores y gobernanza a nivel de cláusula para entrenamiento de modelos, derechos de datos, responsabilidad y auditabilidad. Si tu acuerdo de proveedor de IA no aborda estos puntos, negocia antes de comenzar.

- Asignación de roles: Designa quién genera borradores de IA, quién los revisa y quién tiene autoridad de aprobación final. Estas deben ser personas diferentes.

- Capacitación: Cada miembro del equipo que use herramientas de IA debe entender los modos de fallo comunes, especialmente las alucinaciones, antes de usar la plataforma en asuntos activos.

Aquí hay una descripción práctica de cómo se ve un flujo de trabajo de redacción de IA gobernado en dimensiones clave:

| Dimensión | Qué abordar | Punto de control de revisión | |---|---|---| | Selección de herramientas | Seguimiento de fuentes, privacidad, registros de auditoría | Antes de la incorporación | | Diseño de indicaciones | Especificidad, jurisdicción, tipo de cláusula | Antes de la generación | | Revisión de resultados | Precisión, citas, ajuste legal | Después de la generación | | Contrato de proveedor | Derechos de datos, responsabilidad, entrenamiento de modelos | Antes de la firma del contrato | | Registros de auditoría | Indicaciones, revisores, resultados | Continuo |

Consejo profesional: Mantén un registro continuo de cada tarea de contrato asistida por IA, incluyendo la indicación utilizada, el revisor asignado y el resultado de la verificación. Este registro es tu mejor defensa si un cliente o regulador alguna vez cuestiona tu proceso. También construye conocimiento institucional sobre qué patrones de indicaciones producen resultados confiables y cuáles necesitan refinamiento.

Construir gobernanza de IA en flujos de trabajo legales desde el principio requiere esfuerzo, pero se amortiza la primera vez que surge una disputa de contrato y puedes mostrar una cadena clara y documentada de supervisión humana.

El proceso de redacción de contratos: integración responsable de IA paso a paso

La preparación está completa. Ahora comienza el trabajo de redacción real. Los pasos a continuación reflejan un proceso que es tanto eficiente como defendible. Omitir pasos, especialmente las puertas de verificación, es donde los equipos tienen problemas.

- Define el alcance. Antes de abrir cualquier herramienta de IA, documenta el tipo de contrato, ley aplicable, jurisdicción, partes clave y cualquier término no estándar. Este documento de alcance se convierte en la base para tu indicación y tu lista de verificación de revisión.

- Selecciona una plantilla o precedente. La IA funciona mejor cuando trabaja a partir de una estructura conocida. Comienza con una plantilla aprobada por la firma o un precedente específico de la jurisdicción. Alimenta ese contexto a la IA en lugar de pedirle que genere desde cero.

- Elabora una indicación estructurada. Especifica la ley aplicable, jurisdicción, tipo de cláusula y cualquier obligación específica o exclusión. Las indicaciones vagas producen contratos vagos.

- Genera el borrador. Ejecuta la indicación y captura el resultado completo, incluyendo cualquier cita de fuente que la herramienta proporcione. No edites aún.

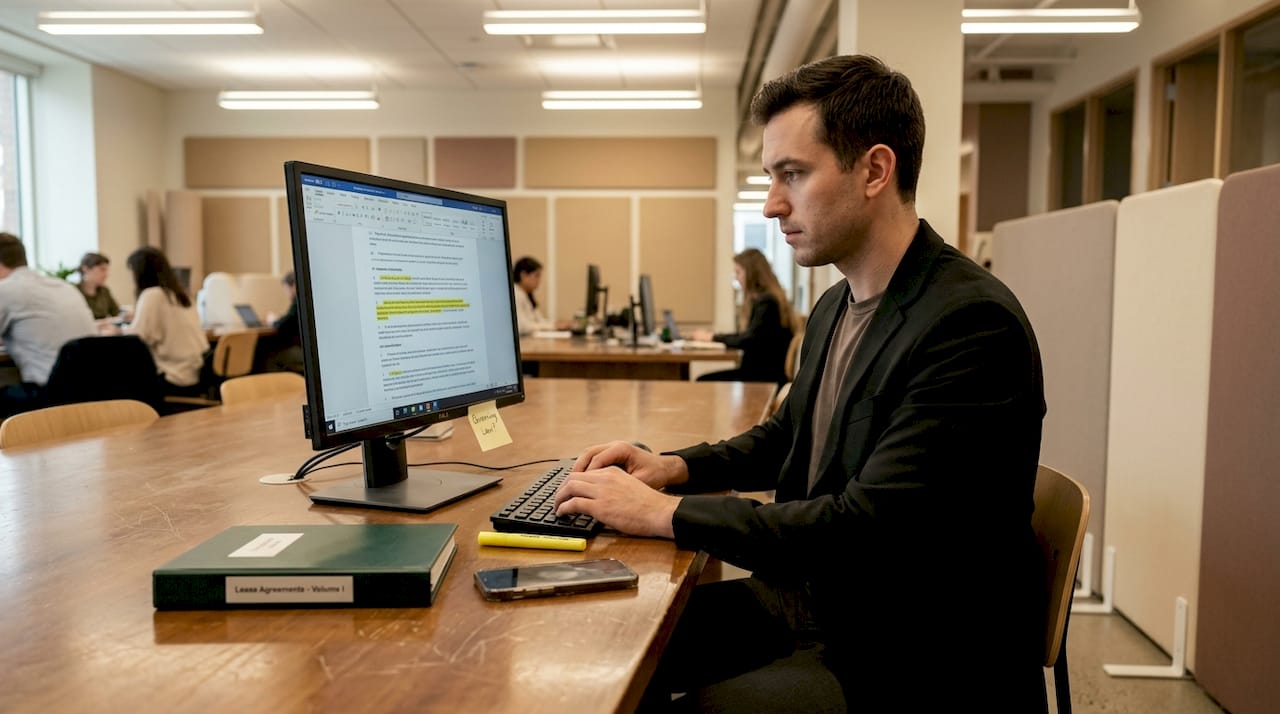

- Puerta de revisión humana. Un revisor calificado lee el borrador completo contra el documento de alcance. Esto no es un vistazo. Es una revisión línea por línea con la plantilla original abierta para comparación.

- Paso de verificación. Cada estatuto citado, caso o referencia regulatoria se verifica independientemente contra fuentes primarias. Cada afirmación jurisdiccional se verifica. Cada término definido se confirma para consistencia.

- Liberación o devolución para revisión. Si el borrador pasa la verificación, avanza. Si falla, vuelve para revisión dirigida, no una generación de IA nueva sin entender qué salió mal.

Los puntos de referencia empíricos sugieren que algunas herramientas de IA pueden igualar o superar a los humanos en tareas de redacción limitadas, pero la verificación humana sigue siendo necesaria porque la precisión no es perfecta y el riesgo varía significativamente según el caso de uso. Una IA de alto rendimiento en un NDA estándar no es lo mismo que una IA de alto rendimiento en un acuerdo de adquisición transfronterizo con ganchos regulatorios multijurisdiccionales.

Aquí se comparan los tres enfoques de redacción en dimensiones clave de riesgo y eficiencia:

| Factor | Redacción manual | IA asistida, sin verificación | IA asistida con verificación | |---|---|---|---| | Velocidad | Lenta | Rápida | Moderada | | Precisión de citas | Alta | Variable | Alta | | Riesgo de alucinación | Ninguno | Alto | Bajo | | Defensa | Alta | Baja | Alta | | Ganancia de eficiencia | Línea base | Alta pero riesgosa | Significativa y segura |

La columna del medio es la trampa. Los equipos que adoptan IA por velocidad pero omiten verificación obtienen lo peor de ambos mundos: borradores rápidos con errores ocultos y sin registro de auditoría que muestre que verificaron.

Consejo profesional: Usa indicaciones estructuradas que especifiquen el tipo exacto de cláusula, ley aplicable y cualquier marco regulatorio que se aplique. Por ejemplo: "Redacta una cláusula de limitación de responsabilidad regida por la ley de Nueva York para un acuerdo de software como servicio entre dos entidades comerciales, excluyendo daños consecuentes." Ese nivel de especificidad produce resultados que son mucho más fáciles de verificar contra un flujo de trabajo confiable de redacción de contratos.

Solución de problemas y mitigación de riesgos comunes: alucinaciones, casos extremos y fallos de cumplimiento

Incluso los flujos de trabajo bien diseñados encuentran problemas. El objetivo no es eliminar todo error de IA, lo cual actualmente no es posible. El objetivo es detectar errores antes de que importen.

Los modos de fallo más comunes en la redacción de contratos asistida por IA incluyen:

- Citas alucinadas: La IA inventa un estatuto, caso o referencia regulatoria que no existe o cita una fuente real para una proposición que en realidad no respalda.

- Conceptos legales mezclados: La IA fusiona estándares de diferentes jurisdicciones o marcos legales, produciendo una cláusula que parece coherente pero aplica la prueba legal incorrecta.

- Desajustes de jurisdicción: La IA aplica suposiciones predeterminadas de un sistema legal (a menudo federal o derecho consuetudinario) a un contrato que requiere tratamiento específico del estado o derecho civil.

- Autoridad desactualizada: La IA cita un estatuto que ha sido enmendado o un caso que ha sido revocado, porque su fecha de corte de datos de entrenamiento es anterior.

- Términos definidos inconsistentes: La IA usa el mismo término con significados ligeramente diferentes en diferentes secciones del mismo contrato.

Los casos extremos que comúnmente rompen la redacción asistida por IA incluyen cláusulas específicas de jurisdicción, precisión de citas y autoridad alucinada. Los flujos de trabajo responsables apuntan explícitamente a estos modos de fallo en lugar de esperar que no aparezcan.

"Nunca confíes, siempre verifica." La Guía de Alucinación de IA del NCSC identifica alucinaciones como citas fabricadas, sentencias distorsionadas, información procesal falsa y conceptos legales mezclados como categorías que requieren verificación humana sistemática, no verificación puntual.

Para auditar efectivamente los resultados de contratos generados por IA, sigue esta secuencia:

Primero, ejecuta cada cita estatutaria contra la versión actual del código relevante. No asumas que la IA tiene el número de sección correcto. Segundo, verifica cada cita de caso extrayendo la decisión real y confirmando la proposición que la IA le atribuyó. Tercero, compara las suposiciones jurisdiccionales en el borrador contra la cláusula de ley aplicable. Cuarto, verifica los términos definidos para consistencia interna en todo el documento. Quinto, marca cualquier cláusula que el revisor no pueda verificar independientemente contra una fuente primaria.

Consejo profesional: Para asuntos sensibles, preserva tus registros de indicaciones y registros de revisión como parte del archivo del asunto. Si un contrato es posteriormente disputado y la parte contraria cuestiona si la IA fue utilizada responsablemente, tu registro de auditoría es la evidencia de que se cumplieron los estándares profesionales. Esta también es una buena práctica para estrategias de verificación de contratos que se mantienen bajo escrutinio regulatorio.

Los riesgos legales y de reputación de errores perdidos no son hipotéticos. Un estatuto fabricado en una cláusula de ley aplicable puede hacer que una disposición sea inaplicable. Un desajuste de jurisdicción en una cláusula de elección de ley puede exponer a un cliente a litigio en un foro inesperado. Estos no son casos extremos. Son los resultados predecibles de tratar el resultado de IA como trabajo terminado.

Por qué tratar la IA como asistente, no como oráculo, cambia los resultados

Aquí está la realidad incómoda que la mayoría de las conversaciones de adopción de IA en la práctica legal evitan: la confianza del resultado de IA no está correlacionada con su precisión. Una herramienta de IA enunciará un estatuto fabricado exactamente en el mismo tono y formato que uno real. Fusionará dos estándares legales incompatibles sin ninguna indicación de que algo está mal. Esa confianza superficial es el peligro real, no la herramienta en sí.

Un enfoque defendible es tratar la IA como un asistente de redacción, no como un oráculo legal. Ese marco requiere competencia, confidencialidad, supervisión y puertas de verificación en cada etapa del proceso.

La sabiduría convencional en círculos de tecnología legal es que la adopción de IA es principalmente un problema de gestión del cambio. Haz que los abogados se sientan cómodos con las herramientas, y el resto sigue. Ese marco es incorrecto de una manera específica e importante. La comodidad con herramientas de IA sin verificación estructurada no es progreso. Es acumulación de riesgo a escala.

Los equipos que obtienen el valor más sostenible de la redacción asistida por IA no son los que usan IA más. Son los que han construido los procesos más claros para cuándo confiar en el resultado de IA y cuándo anularlo. Tratan cada borrador generado por IA como un punto de partida escrito por un asociado junior muy rápido, muy confiado y ocasionalmente incorrecto. Ese modelo mental mantiene al abogado en el rol de verificación en lugar del rol de aprobación pasiva.

Una disciplina práctica que vale la pena construir en la cultura de tu equipo es la autopsia de contrato. Cuando un contrato asistido por IA revela un error durante la revisión, o peor, después de la ejecución, documenta qué sucedió. ¿Qué indicación se utilizó? ¿Qué paso de revisión perdió el error? ¿Qué lo habría detectado antes? Esas lecciones, acumuladas con el tiempo, son lo que convierte un flujo de trabajo genérico de IA en una perspectiva de redacción de IA responsable específica de la firma y continuamente mejorada.

Los equipos que omiten autopsias son los que repiten los mismos errores. Los equipos que las institucionalizan construyen una ventaja competitiva genuina en calidad y defensa.

Explora flujos de trabajo responsables de redacción de contratos vinculados a fuentes

Aplicar estos principios consistentemente requiere más que buenas intenciones. Requiere una plataforma construida para apoyarlos.

Jarel está construido específicamente para profesionales legales que necesitan asistencia de IA que permanezca conectada a sus fuentes. Cada resultado en el espacio de trabajo de Jarel está vinculado al lenguaje de contrato subyacente, estatuto o jurisprudencia que lo informó, para que tu proceso de revisión tenga algo concreto que verificar. La plataforma incluye registros de auditoría, controles de acceso y registros de revisión que hacen que el tipo de flujo de trabajo gobernado descrito en este artículo sea práctico en lugar de teórico. Para equipos listos para pasar del uso ad hoc de IA a un proceso de redacción estructurado y conforme, la plataforma de IA responsable de Jarel proporciona la infraestructura para hacerlo correctamente.

Preguntas frecuentes

¿Cuál es el mayor riesgo de usar IA en redacción de contratos?

El riesgo principal es confiar en contenido generado por IA sin verificación humana, lo que puede llevar a citas alucinadas o errores fácticos que se filtren en contratos ejecutados. El NCSC describe categorías de alucinación incluyendo citas de casos fabricadas, sentencias distorsionadas, información procesal falsa y conceptos legales mezclados entre jurisdicciones.

¿Pueden los abogados usar IA bajo las Reglas Modelo de la ABA?

Sí, los abogados pueden usar IA si mantienen competencia, confidencialidad, supervisión y verificación adecuada del producto de trabajo. ABA Formal Opinion 512 enmarca la IA generativa como una tecnología que los abogados deben usar competentemente bajo deberes profesionales existentes.

¿Significan los puntos de referencia de IA que la revisión humana es innecesaria?

No, incluso las herramientas de IA de mejor rendimiento requieren verificación humana, especialmente para cláusulas de contrato de alto riesgo y citas. Los puntos de referencia empíricos sugieren que algunas herramientas de IA pueden igualar o superar a los humanos en tareas de redacción limitadas, pero la precisión no es perfecta y el riesgo varía significativamente según el caso de uso.

¿Qué términos de contrato deben estar en acuerdos de proveedores de IA?

Incluye disposiciones para derechos de datos, asignación de responsabilidad, restricciones de entrenamiento de modelos, auditabilidad y cumplimiento con marcos regulatorios aplicables. La contratación estructurada de proveedores con gobernanza a nivel de cláusula para estos problemas es un componente reconocido del uso responsable de IA en la práctica legal.