Verträge verantwortungsvoll mit KI-Unterstützung entwerfen

Rechtsabteilungen im ganzen Land erleben eine unbequeme Wahrheit: KI-gestütztes Vertragsdrafting kann stundenlange Arbeit auf Minuten reduzieren – aber ein einziges ungeprüftes Ergebnis kann Fehler einschleusen, die bis zur Unterzeichnung überleben. Ein Inhouse-Team verließ sich kürzlich auf ein KI-Tool zur Erstellung eines Lieferantenvertrags und stellte fest, dass die Freistellungsklausel auf eine nicht existierende Rechtsvorschrift verwies. Die Klausel überstand zwei interne Prüfungen, bevor ein Partner den Fehler entdeckte. Das ist kein Einzelfall, sondern ein Vorgeschmack darauf, was passiert, wenn Geschwindigkeit den Prozess überholt.

Inhaltsverzeichnis

- Pflichten verstehen: Kompetenz, Vertraulichkeit und Aufsicht

- Vorbereitung: Einen Workflow für verantwortungsvolles KI-Vertragsdrafting aufbauen

- Der Vertragsdrafting-Prozess: Verantwortungsvolle KI-Integration Schritt für Schritt

- Häufige Risiken erkennen und entschärfen: Halluzinationen, Grenzfälle und Compliance-Versagen

- Warum es Ergebnisse verändert, KI als Assistenten und nicht als Orakel zu betrachten

- Verantwortungsvolle, quellenbasierte KI-Vertragsworkflows entdecken

- Häufig gestellte Fragen

Wichtige Erkenntnisse

| Punkt | Details | | --- | --- | | Menschliche Prüfung ist unverzichtbar | KI-generierte Entwürfe stets als ungeprüft behandeln, bis sie von einem juristischen Fachmann gründlich überprüft wurden. | | Berufspflichten kennen | Anwälte müssen bei der Integration von KI-Tools Kompetenz, Vertraulichkeit und Aufsicht wahren. | | Workflows auditieren und dokumentieren | Nachvollziehbare Aufzeichnungen über KI-Prompts, Prüfer und Vertragsänderungen führen, um Compliance und Verteidigungsfähigkeit zu sichern. | | Typische Schwachstellen gezielt prüfen | Fokus der Prüfung auf Zitate, Rechtsvorschriften, Gerichtsstandsklauseln und mögliche Halluzinationen legen. | | Strukturierte Verträge mit KI-Anbietern | Datennutzung, Risiko und Auditrechte bei der Nutzung externer KI-Tools vertraglich regeln. |

Pflichten verstehen: Kompetenz, Vertraulichkeit und Aufsicht

Bevor ein KI-Tool überhaupt einen Vertrag berührt, müssen Juristen klar verstehen, was die berufliche Verantwortung tatsächlich verlangt. Die Regeln wurden für KI nicht neu geschrieben – sie wurden auf KI angewendet.

Das ABA Formal Opinion 512 versteht generative KI als Technologie, die Anwälte unter bestehenden Pflichten kompetent einzusetzen haben – einschließlich Vertraulichkeit, Aufsicht und Überprüfung des Arbeitsergebnisses. Diese Einordnung ist wichtig: Sie bedeutet, dass der Anwalt, der einen Prompt ausführt und das Ergebnis in einen Vertragsentwurf einfügt, weiterhin der Berufsträger ist, der für jedes einzelne Wort in diesem Dokument verantwortlich ist.

Die zentralen Pflichten beim Einsatz von KI im Vertragsdrafting umfassen:

- Kompetenz: Sie müssen genug darüber verstehen, wie das KI-Tool funktioniert, um zu erkennen, wann es voraussichtlich versagt – nicht nur, wann es funktioniert.

- Vertraulichkeit: In eine externe KI-Plattform hochgeladene Mandantendaten können gespeichert, für Modelltraining verwendet oder bei Sicherheitsvorfällen offengelegt werden. Die Verschwiegenheitspflicht verlangt, diese Risiken zu kennen, bevor Sie etwas eingeben.

- Aufsicht: Wenn ein Junior Associate oder Paralegal KI-gestützte Entwürfe erstellt, ist der aufsichtsführende Anwalt für das Ergebnis so verantwortlich, als hätte er es selbst geschrieben.

- Überprüfung: KI-generierter Text ist ein ungeprüfter Entwurf. Punkt. Er muss in jeder Phase so behandelt werden.

„Anwälte bleiben für sämtliche Arbeitsergebnisse verantwortlich, unabhängig davon, mit welchem Werkzeug sie erstellt wurden. Generative KI überträgt oder verwässert die berufliche Verantwortung nicht."

Mit einer festen internen Richtlinie zu beginnen, die diese Pflichten in Ihren Workflow einbettet, ist nicht optional. Es ist die Grundlage. Plattformen, die auf KI-Drafting-Prinzipien aufbauen, helfen Teams dabei, diese Verpflichtungen operativ umzusetzen, statt sie als abstrakte Erinnerungen in einer Compliance-Checkliste zu belassen.

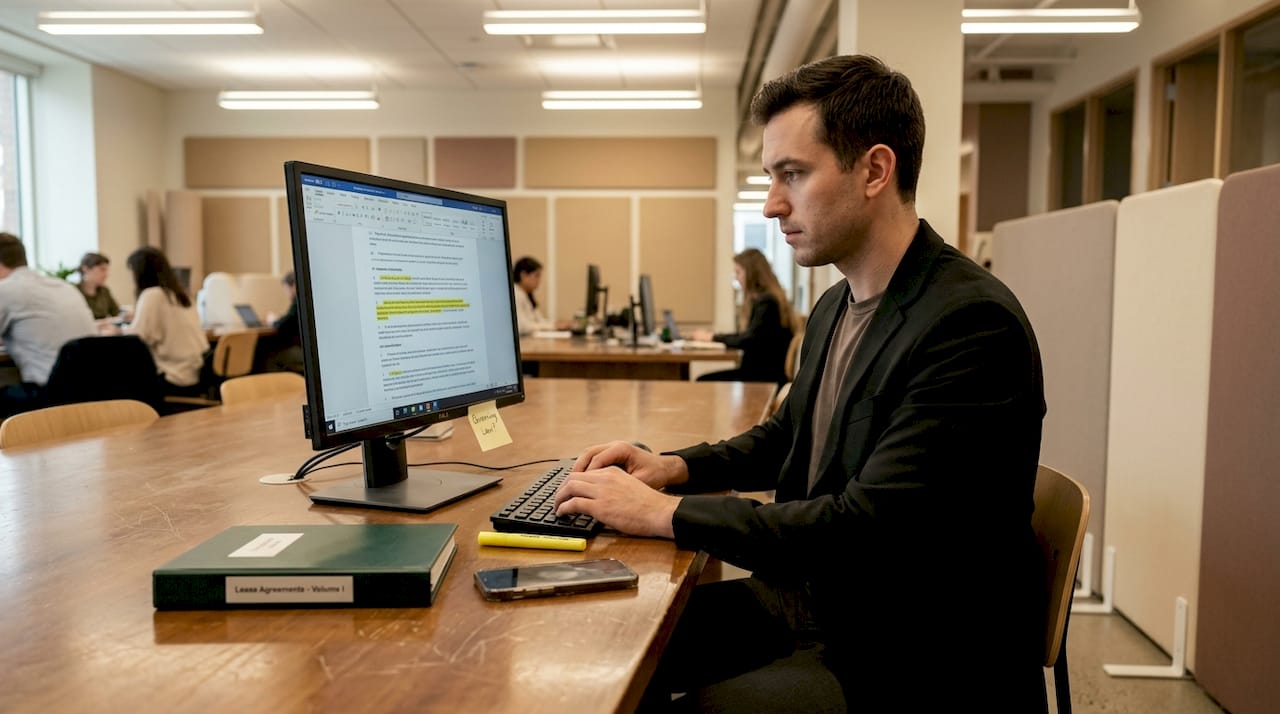

Vorbereitung: Einen Workflow für verantwortungsvolles KI-Vertragsdrafting aufbauen

Die Pflichten zu kennen ist der Ausgangspunkt. Einen Workflow zu schaffen, der sie tatsächlich durchsetzt, ist die schwierigere Aufgabe. Die meisten Teams, die mit KI-gestütztem Drafting in Schwierigkeiten geraten, scheitern nicht daran, dass sie Standesregeln ignoriert haben. Sie scheitern daran, dass sie diese Regeln nie in konkrete Prozessschritte übersetzt haben.

Ein verantwortungsvoller Vertragsdrafting-Workflow sollte Prüfschritte operationalisieren: KI-Texte als ungeprüfte Entwürfe behandeln und vor Freigabe oder Verwendung eine menschliche Verifizierung verlangen. Das ist keine Empfehlung. Es ist der Mindeststandard für eine verteidigungsfähige Praxis.

Bevor Ihr Team einen einzigen KI-gestützten Vertrag entwirft, arbeiten Sie diese Vorbereitungs-Checkliste ab:

- Richtlinienebene: Eine interne KI-Nutzungsrichtlinie entwerfen und verabschieden, die festlegt, welche Tools zugelassen sind, welche Daten geteilt werden dürfen und wer für welche Aufgaben KI einsetzen darf.

- Tool-Auswahl: Plattformen wählen, die Quellenverfolgung, Audit-Logs, Zugriffskontrollen und klare Datenaufbewahrungsrichtlinien bieten. Tools meiden, die nicht nachweisen können, woher eine Klausel stammt.

- Lieferantenverträge: Verantwortungsvoller Einsatz kann strukturierte Verträge mit Anbietern und klauselgenaue Governance zu Modelltraining, Datenrechten, Haftung und Auditierbarkeit umfassen. Wenn Ihr KI-Anbietervertrag diese Punkte nicht regelt, verhandeln Sie sie nach, bevor Sie produktiv gehen.

- Rollenverteilung: Festlegen, wer KI-Entwürfe erstellt, wer sie prüft und wer die endgültige Freigabe erteilt. Das sollten unterschiedliche Personen sein.

- Schulung: Jedes Teammitglied, das KI-Tools nutzt, sollte typische Fehlermuster – insbesondere Halluzinationen – kennen, bevor es die Plattform in laufenden Mandaten einsetzt.

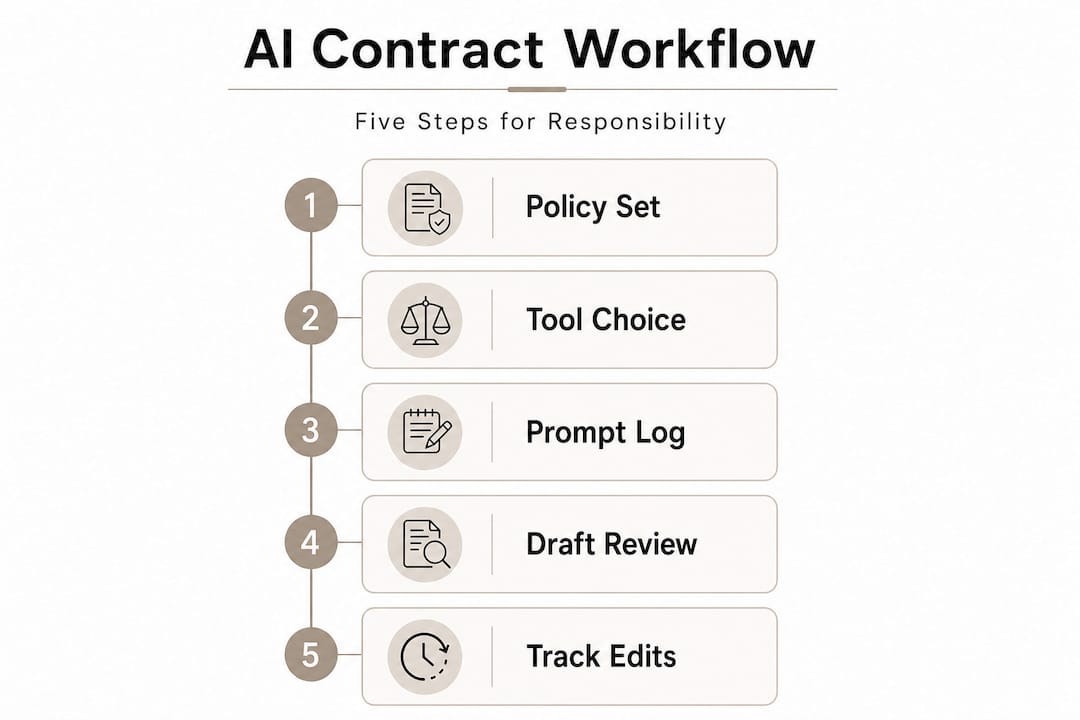

Hier ein praxisnaher Überblick darüber, wie ein gesteuerter KI-Drafting-Workflow in den wichtigsten Dimensionen aussieht:

| Dimension | Was zu regeln ist | Prüfzeitpunkt | |---|---|---| | Tool-Auswahl | Quellenverfolgung, Datenschutz, Audit-Logs | Vor dem Onboarding | | Prompt-Design | Spezifität, Jurisdiktion, Klauseltyp | Vor der Generierung | | Output-Prüfung | Genauigkeit, Zitate, juristische Passung | Nach der Generierung | | Anbietervertrag | Datenrechte, Haftung, Modelltraining | Vor Vertragsabschluss | | Audit-Aufzeichnungen | Prompts, Prüfer, Ergebnisse | Laufend |

Profi-Tipp: Führen Sie ein laufendes Protokoll jeder KI-gestützten Vertragsaufgabe, einschließlich des verwendeten Prompts, des zugewiesenen Prüfers und des Ergebnisses der Verifizierung. Dieses Protokoll ist Ihre beste Verteidigung, wenn ein Mandant oder eine Aufsichtsbehörde Ihren Prozess hinterfragt. Es baut zugleich institutionelles Wissen darüber auf, welche Prompt-Muster verlässliche Ergebnisse liefern und welche nachgeschärft werden müssen.

KI-Governance in juristischen Workflows von Grund auf aufzubauen kostet Mühe, aber sie zahlt sich beim ersten Vertragsstreit aus, wenn Sie eine klare, dokumentierte Kette menschlicher Aufsicht vorweisen können.

Der Vertragsdrafting-Prozess: Verantwortungsvolle KI-Integration Schritt für Schritt

Die Vorbereitung ist abgeschlossen. Jetzt beginnt die eigentliche Drafting-Arbeit. Die folgenden Schritte beschreiben einen Prozess, der zugleich effizient und verteidigungsfähig ist. Schritte zu überspringen – insbesondere die Verifizierungsstufen – ist der Punkt, an dem Teams in Schwierigkeiten geraten.

- Den Umfang definieren. Bevor Sie ein KI-Tool öffnen, dokumentieren Sie Vertragstyp, anwendbares Recht, Gerichtsstand, wesentliche Parteien und alle nicht standardmäßigen Bedingungen. Dieses Scope-Dokument bildet die Grundlage für Ihren Prompt und Ihre Prüf-Checkliste.

- Eine Vorlage oder ein Präzedenzdokument auswählen. KI arbeitet besser, wenn sie auf einer bekannten Struktur aufbaut. Beginnen Sie mit einer kanzleifreigegebenen Vorlage oder einem länderspezifischen Präzedenzdokument. Übergeben Sie diesen Kontext an die KI, statt sie aus dem Nichts heraus generieren zu lassen.

- Einen strukturierten Prompt formulieren. Geben Sie anwendbares Recht, Gerichtsstand, Klauseltyp und etwaige spezifische Verpflichtungen oder Ausnahmen an. Vage Prompts erzeugen vage Verträge.

- Den Entwurf generieren. Den Prompt ausführen und die vollständige Ausgabe einschließlich aller vom Tool gelieferten Quellenangaben erfassen. Noch nicht bearbeiten.

- Menschliche Prüfstufe. Ein qualifizierter Prüfer liest den gesamten Entwurf gegen das Scope-Dokument. Das ist kein Überfliegen. Es ist eine zeilenweise Prüfung mit der Originalvorlage zum Vergleich.

- Verifizierungsdurchgang. Jede zitierte Vorschrift, jeder Fall und jede regulatorische Referenz wird unabhängig anhand von Primärquellen überprüft. Jede Aussage zur Jurisdiktion wird kontrolliert. Jeder definierte Begriff wird auf Konsistenz geprüft.

- Freigabe oder Rückgabe zur Überarbeitung. Besteht der Entwurf die Verifizierung, geht er weiter. Andernfalls wird er gezielt überarbeitet – nicht einfach erneut von der KI generiert, ohne zu verstehen, was schiefgelaufen ist.

Empirische Benchmarks legen nahe, dass einige KI-Tools bei begrenzten Drafting-Aufgaben mit Menschen mithalten oder sie übertreffen können – menschliche Verifizierung bleibt jedoch notwendig, weil Genauigkeit nicht perfekt ist und das Risiko je nach Einsatzfall stark variiert. Eine starke KI-Leistung bei einer Standard-NDA ist nicht dasselbe wie eine starke KI-Leistung bei einem grenzüberschreitenden Übernahmevertrag mit mehrjurisdiktionellen regulatorischen Anknüpfungspunkten.

So lassen sich die drei Drafting-Ansätze in den zentralen Risiko- und Effizienzdimensionen vergleichen:

| Faktor | Manuelles Drafting | KI-gestützt, ohne Verifizierung | KI-gestützt mit Verifizierung | |---|---|---|---| | Geschwindigkeit | Langsam | Schnell | Mittel | | Zitiergenauigkeit | Hoch | Variabel | Hoch | | Halluzinationsrisiko | Keines | Hoch | Gering | | Verteidigungsfähigkeit | Hoch | Gering | Hoch | | Effizienzgewinn | Basislinie | Hoch, aber riskant | Erheblich und sicher |

Die mittlere Spalte ist die Falle. Teams, die KI für Tempo einsetzen, aber die Verifizierung auslassen, bekommen das Schlechteste aus beiden Welten: schnelle Entwürfe mit verborgenen Fehlern und keine Audit-Spur, die belegt, dass geprüft wurde.

Profi-Tipp: Verwenden Sie strukturierte Prompts, die exakt den Klauseltyp, das anwendbare Recht und alle relevanten regulatorischen Rahmen angeben. Zum Beispiel: „Erstelle eine Haftungsbeschränkungsklausel nach New Yorker Recht für einen Software-as-a-Service-Vertrag zwischen zwei kommerziellen Unternehmen, unter Ausschluss von Folgeschäden." Diese Spezifität liefert Ergebnisse, die sich deutlich leichter gegen einen verlässlichen Vertragsdrafting-Workflow verifizieren lassen.

Häufige Risiken erkennen und entschärfen: Halluzinationen, Grenzfälle und Compliance-Versagen

Auch gut konzipierte Workflows stoßen auf Probleme. Das Ziel ist nicht, jeden KI-Fehler auszuschließen – das ist derzeit nicht möglich. Das Ziel ist, Fehler zu erkennen, bevor sie Schaden anrichten.

Die häufigsten Fehlermuster im KI-gestützten Vertragsdrafting umfassen:

- Halluzinierte Zitate: Die KI erfindet eine Vorschrift, einen Fall oder eine regulatorische Referenz, die nicht existiert, oder zitiert eine reale Quelle für eine Aussage, die diese gar nicht stützt.

- Vermischte Rechtskonzepte: Die KI mischt Standards aus unterschiedlichen Jurisdiktionen oder Rechtsrahmen und erzeugt eine scheinbar kohärente Klausel, die jedoch den falschen rechtlichen Maßstab anwendet.

- Falsche Jurisdiktion: Die KI überträgt Standardannahmen eines Rechtssystems (häufig US-Bundesrecht oder Common Law) auf einen Vertrag, der eine bundesstaatsspezifische oder zivilrechtliche Behandlung erfordert.

- Veraltete Quellen: Die KI zitiert eine geänderte Vorschrift oder einen aufgehobenen Fall, weil ihre Trainingsdaten einen Stichtag haben.

- Inkonsistente Definitionen: Die KI verwendet denselben Begriff in unterschiedlichen Abschnitten desselben Vertrags mit leicht abweichender Bedeutung.

Grenzfälle, die KI-gestütztes Drafting häufig zu Fall bringen, umfassen jurisdiktionsspezifische Klauseln, Zitiergenauigkeit und halluzinierte Quellen. Verantwortungsvolle Workflows adressieren diese Fehlermuster gezielt, statt zu hoffen, dass sie nicht auftreten.

„Niemals vertrauen, immer verifizieren." Der NCSC AI Hallucination Guide identifiziert Halluzinationen wie erfundene Zitate, verzerrte Urteilsaussagen, falsche Verfahrensinformationen und vermischte Rechtskonzepte als Kategorien, die systematische menschliche Verifizierung erfordern – nicht stichprobenartige Kontrollen.

Um KI-generierte Vertragsergebnisse wirksam zu auditieren, gehen Sie wie folgt vor:

Prüfen Sie zunächst jede Gesetzeszitierung gegen die aktuelle Fassung des einschlägigen Kodex. Verlassen Sie sich nicht darauf, dass die KI die richtige Paragrafennummer hat. Zweitens, verifizieren Sie jede Fallzitierung, indem Sie die tatsächliche Entscheidung heranziehen und die Aussage bestätigen, die die KI ihr zugeschrieben hat. Drittens, vergleichen Sie die Jurisdiktionsannahmen im Entwurf mit der Rechtswahlklausel. Viertens, prüfen Sie definierte Begriffe auf interne Konsistenz im gesamten Dokument. Fünftens, markieren Sie jede Klausel, die der Prüfer nicht unabhängig anhand einer Primärquelle verifizieren kann.

Profi-Tipp: Bewahren Sie bei sensiblen Mandaten Ihre Prompt-Logs und Prüfprotokolle als Teil der Mandatsakte auf. Wird ein Vertrag später bestritten und die Gegenseite stellt die verantwortungsvolle Nutzung von KI in Frage, ist Ihre Audit-Spur der Nachweis, dass berufsrechtliche Standards eingehalten wurden. Das ist auch eine bewährte Praxis für Vertragsverifizierungsstrategien, die einer aufsichtsrechtlichen Prüfung standhalten.

Die rechtlichen und reputationsbezogenen Risiken übersehener Fehler sind nicht hypothetisch. Eine erfundene Vorschrift in einer Rechtswahlklausel kann eine Bestimmung unwirksam machen. Eine falsche Jurisdiktion in einer Rechtswahlklausel kann einen Mandanten Verfahren in einem unerwarteten Forum aussetzen. Das sind keine Grenzfälle. Das sind die vorhersehbaren Folgen, KI-Output als fertige Arbeit zu behandeln.

Warum es Ergebnisse verändert, KI als Assistenten und nicht als Orakel zu betrachten

Hier ist die unbequeme Realität, die in Diskussionen über KI-Adoption in der juristischen Praxis meist umgangen wird: Die Selbstsicherheit eines KI-Outputs korreliert nicht mit seiner Genauigkeit. Ein KI-Tool präsentiert eine erfundene Vorschrift in exakt demselben Ton und Format wie eine echte. Es vermischt zwei unvereinbare rechtliche Standards, ohne irgendeinen Hinweis darauf, dass etwas nicht stimmt. Diese oberflächliche Selbstsicherheit ist die eigentliche Gefahr – nicht das Tool selbst.

Ein verteidigungsfähiger Ansatz besteht darin, KI als Drafting-Assistenten zu behandeln, nicht als juristisches Orakel. Diese Sichtweise verlangt Kompetenz, Vertraulichkeit, Aufsicht und Verifizierungsstufen in jeder Prozessphase.

Die gängige Meinung in Legal-Tech-Kreisen ist, dass KI-Adoption primär ein Change-Management-Problem sei: Sorge dafür, dass Anwälte sich mit den Tools wohlfühlen, dann folge der Rest. Diese Sichtweise ist auf eine spezifische und wichtige Weise falsch. Vertrautheit mit KI-Tools ohne strukturierte Verifizierung ist kein Fortschritt. Es ist Risikoakkumulation in großem Maßstab.

Die Teams, die langfristig den größten Nutzen aus KI-gestütztem Drafting ziehen, sind nicht jene, die KI am meisten einsetzen. Es sind die Teams, die die klarsten Prozesse dafür entwickelt haben, wann sie KI-Output vertrauen und wann sie ihn überstimmen. Sie behandeln jeden KI-generierten Entwurf als Ausgangspunkt, geschrieben von einem sehr schnellen, sehr selbstbewussten und gelegentlich falschen Junior Associate. Dieses mentale Modell hält den Anwalt in der Verifizierungsrolle – und nicht in der passiven Freigaberolle.

Eine praktische Disziplin, die es lohnt, in die Teamkultur einzubauen, ist die Vertrags-Postmortem. Wenn ein KI-gestützter Vertrag während der Prüfung – oder schlimmer, nach der Unterzeichnung – einen Fehler offenbart, dokumentieren Sie, was passiert ist. Welcher Prompt wurde verwendet? Welcher Prüfschritt hat den Fehler übersehen? Was hätte ihn früher entdeckt? Diese Erkenntnisse, über die Zeit gesammelt, verwandeln einen generischen KI-Workflow in eine kanzleispezifische, kontinuierlich verbesserte Perspektive auf verantwortungsvolles KI-Drafting.

Die Teams, die Postmortems überspringen, wiederholen dieselben Fehler. Die Teams, die sie institutionalisieren, bauen einen echten Wettbewerbsvorteil in Qualität und Verteidigungsfähigkeit auf.

Verantwortungsvolle, quellenbasierte KI-Vertragsworkflows entdecken

Diese Prinzipien konsequent anzuwenden erfordert mehr als guten Willen. Es erfordert eine Plattform, die darauf ausgelegt ist, sie zu unterstützen.

Jarel ist speziell für Juristen entwickelt, die KI-Unterstützung benötigen, die mit ihren Quellen verbunden bleibt. Jeder Output im Jarel-Workspace ist mit dem zugrunde liegenden Vertragstext, der Vorschrift oder der Rechtsprechung verknüpft, auf der er basiert – damit Ihre Prüfung etwas Konkretes hat, gegen das sie verifizieren kann. Die Plattform umfasst Audit-Logs, Zugriffskontrollen und Prüfprotokolle, die den in diesem Beitrag beschriebenen gesteuerten Workflow praxistauglich machen, statt ihn theoretisch zu belassen. Für Teams, die bereit sind, von ad-hoc-KI-Nutzung zu einem strukturierten, konformen Drafting-Prozess überzugehen, bietet die verantwortungsvolle KI-Plattform von Jarel die Infrastruktur, um es richtig zu machen.

Häufig gestellte Fragen

Was ist das größte Risiko beim Einsatz von KI im Vertragsdrafting?

Das wesentliche Risiko besteht darin, sich auf KI-generierte Inhalte ohne menschliche Verifizierung zu verlassen, wodurch halluzinierte Zitate oder sachliche Fehler in unterzeichnete Verträge gelangen können. NCSC beschreibt Halluzinationskategorien, darunter erfundene Fallzitate, verzerrte Urteilsaussagen, falsche Verfahrensinformationen und über Jurisdiktionen hinweg vermischte Rechtskonzepte.

Dürfen Anwälte gemäß den ABA Model Rules KI einsetzen?

Ja, Anwälte dürfen KI nutzen, wenn sie Kompetenz, Vertraulichkeit, Aufsicht und ordnungsgemäße Verifizierung über das Arbeitsergebnis aufrechterhalten. ABA Formal Opinion 512 versteht generative KI als Technologie, die Anwälte unter bestehenden Berufspflichten kompetent einsetzen müssen.

Bedeuten KI-Benchmarks, dass menschliche Prüfung überflüssig ist?

Nein, selbst Spitzen-KI-Tools erfordern menschliche Verifizierung – insbesondere bei risikoreichen Vertragsklauseln und Zitaten. Empirische Benchmarks legen nahe, dass einige KI-Tools bei begrenzten Drafting-Aufgaben mit Menschen mithalten oder sie übertreffen können, doch Genauigkeit ist nicht perfekt und das Risiko variiert je nach Anwendungsfall erheblich.

Welche Vertragsbestimmungen sollten in KI-Anbieterverträgen enthalten sein?

Aufnehmen sollten Sie Regelungen zu Datenrechten, Haftungsverteilung, Beschränkungen für Modelltraining, Auditierbarkeit und Compliance mit den einschlägigen regulatorischen Rahmen. Strukturierte Anbieterverträge mit klauselgenauer Governance dieser Themen sind ein anerkannter Bestandteil des verantwortungsvollen KI-Einsatzes in der juristischen Praxis.