Rédiger des contrats de manière responsable avec l'assistance de l'IA

Les équipes juridiques du pays découvrent une vérité difficile : la rédaction de contrats assistée par l'IA peut réduire les heures de travail à quelques minutes, mais une seule sortie non vérifiée peut introduire des erreurs qui survivent jusqu'à l'exécution. Une équipe interne a récemment utilisé un outil d'IA pour générer un accord de fournisseur, seulement pour découvrir que la clause d'indemnisation citait un statut qui n'existait pas. La clause a passé deux examens internes avant qu'un associé ne la détecte. Ce scénario n'est pas une exception. C'est un aperçu de ce qui se passe quand la vitesse dépasse le processus.

Table des matières

- Comprendre vos obligations : compétence, confidentialité et supervision

- Préparation : construire un flux de travail pour la rédaction responsable de contrats assistée par l'IA

- Le processus de rédaction de contrats : intégration responsable de l'IA étape par étape

- Dépannage et atténuation des risques courants : hallucinations, cas limites et défaillances de conformité

- Pourquoi traiter l'IA comme un assistant, pas comme un oracle, change les résultats

- Explorez les flux de travail responsables de rédaction de contrats avec sources

- Questions fréquemment posées

Points clés à retenir

| Point | Détails | | --- | --- | | La vérification humaine est essentielle | Traitez toujours les brouillons générés par l'IA comme non vérifiés jusqu'à ce qu'ils soient examinés en détail par un expert juridique. | | Comprendre les obligations juridiques | Les avocats doivent appliquer la compétence, la confidentialité et la supervision lors de l'intégration d'outils d'IA. | | Auditer et documenter les flux de travail | Conservez des enregistrements traçables des invites d'IA, des examinateurs et des modifications de contrats pour la conformité et la défendabilité. | | Cibler les points de défaillance courants | Concentrez l'examen sur les citations, les statuts, les clauses de juridiction et les hallucinations possibles. | | Contrats structurés avec les fournisseurs d'IA | Régissez contractuellement l'utilisation des données, le risque et les droits d'audit lors de l'utilisation d'outils d'IA tiers. |

Comprendre vos obligations : compétence, confidentialité et supervision

Avant que tout outil d'IA ne touche à un contrat, les professionnels du droit doivent être clairs sur ce que la responsabilité professionnelle exige réellement. Les règles n'ont pas été réécrites pour l'IA. Elles lui ont été appliquées.

L'Avis formel ABA 512 encadre l'IA générative comme une technologie que les avocats doivent utiliser de manière compétente selon les obligations existantes, y compris la confidentialité, la supervision et la vérification du travail. Cet encadrement est important. Cela signifie que l'avocat qui exécute une invite et colle la sortie dans un brouillon de contrat est toujours le professionnel responsable de chaque mot de ce document.

Les obligations fondamentales qui s'appliquent lors de l'utilisation de l'IA dans la rédaction de contrats incluent :

- Compétence : Vous devez comprendre suffisamment le fonctionnement de l'outil d'IA pour identifier quand il est susceptible d'échouer, pas seulement quand il réussit.

- Confidentialité : Les données clients téléchargées sur une plateforme d'IA tiers peuvent être conservées, utilisées pour l'entraînement du modèle ou exposées à une violation. L'obligation de confidentialité vous oblige à comprendre ces risques avant de saisir quoi que ce soit.

- Supervision : Si un associé junior ou un assistant juridique exécute des brouillons assistés par l'IA, l'avocat superviseur est responsable de la sortie comme s'il l'avait écrite personnellement.

- Vérification : Le texte généré par l'IA est un brouillon non vérifié. Point final. Il doit être traité de cette façon à chaque étape.

« Les avocats restent responsables de tous les travaux, quel que soit l'outil utilisé pour les générer. L'IA générative ne transfère ni ne dilue la responsabilité professionnelle. »

Commencer par une politique interne de cabinet qui encode ces obligations dans votre flux de travail n'est pas facultatif. C'est la fondation. Les plateformes construites autour des principes de rédaction assistée par l'IA peuvent aider les équipes à opérationnaliser ces obligations plutôt que de les laisser comme des rappels abstraits sur une liste de contrôle de conformité.

Préparation : construire un flux de travail pour la rédaction responsable de contrats assistée par l'IA

Connaître vos obligations est le point de départ. Construire un flux de travail qui les applique réellement est le travail le plus difficile. La plupart des équipes qui rencontrent des problèmes avec la rédaction assistée par l'IA ne échouent pas parce qu'elles ont ignoré les règles d'éthique. Elles échouent parce qu'elles n'ont jamais traduit ces règles en étapes de processus concrètes.

Un flux de travail responsable de rédaction de contrats devrait opérationnaliser les portes d'examen : traiter le texte généré par l'IA comme des brouillons non vérifiés et exiger une vérification humaine avant la publication ou l'utilisation. Ce n'est pas une suggestion. C'est la norme minimale pour une pratique défendable.

Avant que votre équipe rédige un seul contrat assisté par l'IA, parcourez cette liste de contrôle de préparation :

- Couche politique : Rédigez et adoptez une politique interne d'utilisation de l'IA qui spécifie quels outils sont approuvés, quelles données peuvent être partagées et qui est autorisé à utiliser l'IA pour quelles tâches.

- Sélection des outils : Choisissez des plateformes qui offrent le suivi des sources, les journaux d'audit, les contrôles d'accès et des politiques claires de conservation des données. Évitez les outils qui ne peuvent pas vous dire d'où provient une clause.

- Accords avec les fournisseurs : L'utilisation responsable peut inclure la conclusion de contrats structurés avec les fournisseurs et la gouvernance au niveau des clauses pour l'entraînement du modèle, les droits des données, la responsabilité et l'auditabilité. Si votre accord avec le fournisseur d'IA n'aborde pas ces points, négociez-les avant de vous lancer.

- Attribution des rôles : Désignez qui génère les brouillons d'IA, qui les examine et qui a l'autorité de signature finale. Ce devraient être des personnes différentes.

- Formation : Chaque membre de l'équipe utilisant des outils d'IA devrait comprendre les modes de défaillance courants, en particulier les hallucinations, avant d'utiliser la plateforme sur des dossiers actifs.

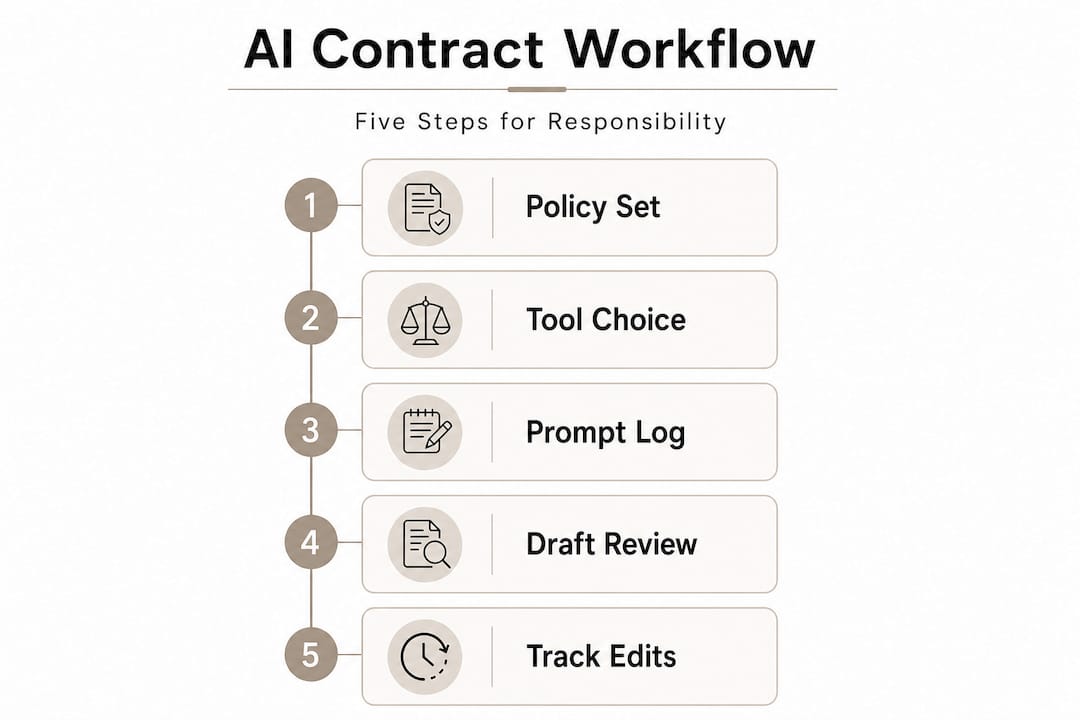

Voici un aperçu pratique de ce à quoi ressemble un flux de travail de rédaction assistée par l'IA gouverné selon les dimensions clés :

| Dimension | Ce qu'il faut aborder | Point de contrôle d'examen | |---|---|---| | Sélection des outils | Suivi des sources, confidentialité, journaux d'audit | Avant l'intégration | | Conception des invites | Spécificité, juridiction, type de clause | Avant la génération | | Examen de la sortie | Exactitude, citations, adéquation juridique | Après la génération | | Contrat avec le fournisseur | Droits des données, responsabilité, entraînement du modèle | Avant la signature du contrat | | Enregistrements d'audit | Invites, examinateurs, résultats | En continu |

Conseil pratique : Conservez un journal courant de chaque tâche de contrat assistée par l'IA, y compris l'invite utilisée, l'examinateur assigné et le résultat de la vérification. Ce journal est votre meilleure défense si un client ou un régulateur remet jamais en question votre processus. Il crée également une connaissance institutionnelle sur les modèles d'invites qui produisent des résultats fiables et ceux qui nécessitent un affinement.

Construire la gouvernance de l'IA dans les flux de travail juridiques à partir de zéro demande des efforts, mais cela en vaut la peine la première fois qu'un différend contractuel survient et que vous pouvez montrer une chaîne claire de surveillance humaine documentée.

Le processus de rédaction de contrats : intégration responsable de l'IA étape par étape

La préparation est terminée. Maintenant, le travail de rédaction réel commence. Les étapes ci-dessous reflètent un processus qui est à la fois efficace et défendable. Sauter des étapes, en particulier les portes de vérification, est là où les équipes rencontrent des problèmes.

- Définir la portée. Avant d'ouvrir un outil d'IA, documentez le type de contrat, la loi applicable, la juridiction, les parties clés et tous les termes non standard. Ce document de portée devient la base de votre invite et de votre liste de contrôle d'examen.

- Sélectionner un modèle ou un précédent. L'IA fonctionne mieux quand elle travaille à partir d'une structure connue. Commencez par un modèle approuvé par le cabinet ou un précédent spécifique à la juridiction. Alimentez ce contexte dans l'IA plutôt que de lui demander de générer à partir de zéro.

- Rédiger une invite structurée. Spécifiez la loi applicable, la juridiction, le type de clause et toute obligation ou exclusion spécifique. Les invites vagues produisent des contrats vagues.

- Générer le brouillon. Exécutez l'invite et capturez la sortie complète, y compris toutes les citations sources que l'outil fournit. N'éditez pas encore.

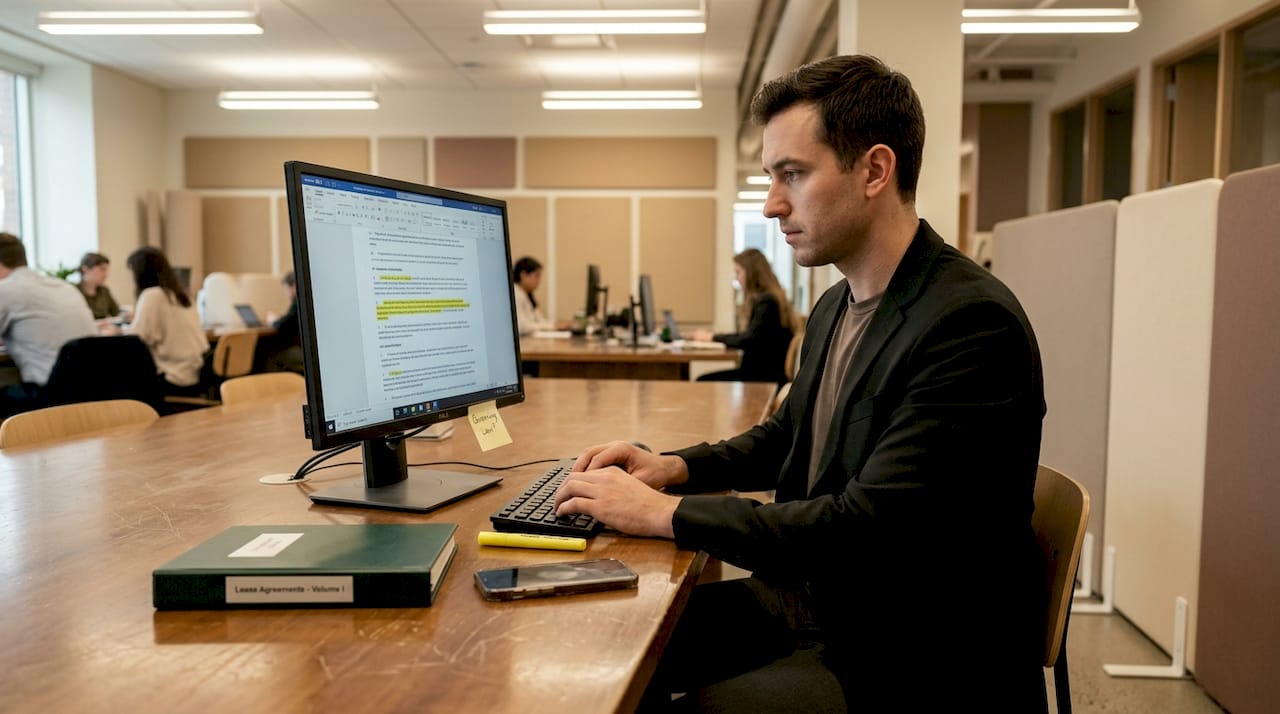

- Porte d'examen humain. Un examinateur qualifié lit l'intégralité du brouillon par rapport au document de portée. Ce n'est pas un survol. C'est un examen ligne par ligne avec le modèle original ouvert pour comparaison.

- Passage de vérification. Chaque statut cité, cas ou référence réglementaire est indépendamment vérifié par rapport aux sources primaires. Chaque affirmation de juridiction est vérifiée. Chaque terme défini est confirmé pour la cohérence.

- Publication ou retour pour révision. Si le brouillon passe la vérification, il avance. S'il échoue, il revient pour une révision ciblée, pas une nouvelle génération d'IA sans comprendre ce qui s'est mal passé.

L'analyse comparative empirique suggère que certains outils d'IA peuvent égaler ou surpasser les humains sur des tâches de rédaction limitées, mais la vérification humaine reste nécessaire car la précision n'est pas parfaite et le risque varie considérablement selon le cas d'usage. Un outil d'IA performant sur un accord de confidentialité standard n'est pas la même chose qu'un outil performant sur un accord d'acquisition transfrontalier avec des crochets réglementaires multijuridictionnels.

Voici comment les trois approches de rédaction se comparent selon les dimensions clés de risque et d'efficacité :

| Facteur | Rédaction manuelle | Assistée par l'IA, sans vérification | Assistée par l'IA avec vérification | |---|---|---|---| | Vitesse | Lente | Rapide | Modérée | | Exactitude des citations | Élevée | Variable | Élevée | | Risque d'hallucination | Aucun | Élevé | Faible | | Défendabilité | Élevée | Faible | Élevée | | Gain d'efficacité | Référence | Élevé mais risqué | Significatif et sûr |

La colonne du milieu est le piège. Les équipes qui adoptent l'IA pour la vitesse mais sautent la vérification obtiennent le pire des deux mondes : des brouillons rapides avec des erreurs cachées et aucune piste d'audit pour montrer qu'elles ont vérifié.

Conseil pratique : Utilisez des invites structurées qui spécifient le type exact de clause, la loi applicable et tout cadre réglementaire qui s'applique. Par exemple : « Rédigez une clause de limitation de responsabilité régie par la loi de New York pour un accord de logiciel en tant que service entre deux entités commerciales, excluant les dommages indirects. » Ce niveau de spécificité produit des résultats qui sont beaucoup plus faciles à vérifier par rapport à un flux de travail fiable de rédaction de contrats.

Dépannage et atténuation des risques courants : hallucinations, cas limites et défaillances de conformité

Même les flux de travail bien conçus rencontrent des problèmes. L'objectif n'est pas d'éliminer toutes les erreurs d'IA, ce qui n'est actuellement pas possible. L'objectif est de détecter les erreurs avant qu'elles ne deviennent importantes.

Les modes de défaillance les plus courants dans la rédaction de contrats assistée par l'IA incluent :

- Citations halluccinées : L'IA invente un statut, un cas ou une référence réglementaire qui n'existe pas ou cite une source réelle pour une proposition qu'elle ne soutient réellement pas.

- Concepts juridiques mélangés : L'IA fusionne les normes de différentes juridictions ou cadres juridiques, produisant une clause qui semble cohérente mais applique le mauvais test juridique.

- Incompatibilités de juridiction : L'IA applique les hypothèses par défaut d'un système juridique (souvent fédéral ou de droit commun) à un contrat qui nécessite un traitement spécifique à l'État ou de droit civil.

- Autorité obsolète : L'IA cite un statut qui a été modifié ou un cas qui a été annulé, car sa date limite de données d'entraînement est antérieure.

- Termes définis incohérents : L'IA utilise le même terme avec des significations légèrement différentes dans différentes sections du même contrat.

Les cas limites qui cassent couramment la rédaction assistée par l'IA incluent les clauses spécifiques à la juridiction, l'exactitude des citations et l'autorité halluccinée. Les flux de travail responsables ciblent explicitement ces modes de défaillance plutôt que d'espérer qu'ils n'apparaissent pas.

« Ne jamais faire confiance, toujours vérifier. » Le Guide des hallucinations d'IA du NCSC identifie les hallucinations telles que les citations fabriquées, les conclusions déformées, les fausses informations procédurales et les concepts juridiques mélangés comme des catégories qui nécessitent une vérification humaine systématique, pas un contrôle ponctuel.

Pour auditer efficacement les résultats de contrats générés par l'IA, suivez cette séquence :

D'abord, exécutez chaque citation statutaire par rapport à la version actuelle du code pertinent. Ne supposez pas que l'IA a le bon numéro de section. Deuxièmement, vérifiez chaque citation de cas en tirant la décision réelle et en confirmant la proposition que l'IA lui a attribuée. Troisièmement, comparez les hypothèses de juridiction dans le brouillon par rapport à la clause de loi applicable. Quatrièmement, vérifiez la cohérence des termes définis dans l'ensemble du document. Cinquièmement, signalez toute clause que l'examinateur ne peut pas indépendamment vérifier par rapport à une source primaire.

Conseil pratique : Pour les questions sensibles, conservez vos journaux d'invites et vos enregistrements d'examen dans le dossier du dossier. Si un contrat est ultérieurement contesté et que le conseil adverse remet en question si l'IA a été utilisée de manière responsable, votre piste d'audit est la preuve que les normes professionnelles ont été respectées. C'est aussi une bonne pratique pour les stratégies de vérification de contrats qui résistent à l'examen réglementaire.

Les risques juridiques et réputationnels des erreurs manquées ne sont pas hypothétiques. Un statut fabriqué dans une clause de loi applicable peut rendre une disposition inexécutoire. Une incompatibilité de juridiction dans une clause de choix de loi peut exposer un client à un litige dans un forum inattendu. Ce ne sont pas des cas limites. Ce sont les résultats prévisibles du traitement de la sortie d'IA comme du travail fini.

Pourquoi traiter l'IA comme un assistant, pas comme un oracle, change les résultats

Voici la réalité inconfortable que la plupart des conversations d'adoption d'IA dans la pratique juridique évitent : la confiance de la sortie d'IA n'est pas corrélée à sa précision. Un outil d'IA énoncera un statut fabriqué exactement du même ton et format qu'un vrai. Il fusionnera deux normes juridiques incompatibles sans aucune indication que quelque chose ne va pas. Cette confiance de surface est le danger réel, pas l'outil lui-même.

Une approche défendable consiste à traiter l'IA comme un assistant de rédaction, pas comme un oracle juridique. Cet encadrement exige la compétence, la confidentialité, la supervision et les portes de vérification à chaque étape du processus.

La sagesse conventionnelle dans les cercles de la technologie juridique est que l'adoption de l'IA est principalement un problème de gestion du changement. Mettez les avocats à l'aise avec les outils, et le reste suit. Cet encadrement est faux d'une manière spécifique et importante. Le confort avec les outils d'IA sans vérification structurée n'est pas un progrès. C'est l'accumulation de risques à grande échelle.

Les équipes qui tirent la plus grande valeur durable de la rédaction assistée par l'IA ne sont pas celles qui utilisent le plus l'IA. Ce sont celles qui ont construit les processus les plus clairs pour savoir quand faire confiance à la sortie d'IA et quand la contourner. Elles traitent chaque brouillon généré par l'IA comme un point de départ écrit par un assistant junior très rapide, très confiant et occasionnellement faux. Ce modèle mental garde l'avocat dans le rôle de vérification plutôt que dans le rôle d'approbation passive.

Une discipline pratique qui vaut la peine d'être intégrée à la culture de votre équipe est l'autopsie de contrat. Quand un contrat assisté par l'IA révèle une erreur lors de l'examen, ou pire, après l'exécution, documentez ce qui s'est passé. Quelle invite a été utilisée ? Quelle étape d'examen a manqué l'erreur ? Qu'aurait pu la détecter plus tôt ? Ces leçons, accumulées au fil du temps, sont ce qui transforme un flux de travail d'IA générique en une perspective de rédaction responsable de contrats assistée par l'IA spécifique au cabinet et continuellement améliorée.

Les équipes qui sautent les autopsies sont celles qui répètent les mêmes erreurs. Les équipes qui les institutionnalisent construisent un véritable avantage concurrentiel en qualité et défendabilité.

Explorez les flux de travail responsables de rédaction de contrats avec sources

Appliquer ces principes de manière cohérente nécessite plus que de bonnes intentions. Cela nécessite une plateforme construite pour les soutenir.

Jarel est construit spécifiquement pour les professionnels du droit qui ont besoin d'une assistance d'IA qui reste connectée à ses sources. Chaque résultat dans l'espace de travail de Jarel est lié au langage de contrat, au statut ou à la jurisprudence sous-jacents qui l'ont informé, de sorte que votre processus d'examen a quelque chose de concret à vérifier. La plateforme inclut des journaux d'audit, des contrôles d'accès et des pistes d'examen qui rendent le type de flux de travail gouverné décrit dans cet article pratique plutôt que théorique. Pour les équipes prêtes à passer de l'utilisation ad hoc de l'IA à un processus de rédaction structuré et conforme, la plateforme d'IA responsable de Jarel fournit l'infrastructure pour le faire correctement.

Questions fréquemment posées

Quel est le plus grand risque d'utiliser l'IA dans la rédaction de contrats ?

Le risque majeur est de s'appuyer sur du contenu généré par l'IA sans vérification humaine, ce qui peut entraîner des citations halluccinées ou des erreurs factuelles qui se glissent dans les contrats exécutés. Le NCSC décrit les catégories d'hallucinations incluant les citations de cas fabriquées, les conclusions déformées, les fausses informations procédurales et les concepts juridiques mélangés entre juridictions.

Les avocats sont-ils autorisés à utiliser l'IA selon les Règles modèles de l'ABA ?

Oui, les avocats peuvent utiliser l'IA s'ils maintiennent la compétence, la confidentialité, la supervision et la vérification appropriée du travail. L'Avis formel ABA 512 encadre l'IA générative comme une technologie que les avocats doivent utiliser de manière compétente selon les obligations professionnelles existantes.

Les analyses comparatives d'IA signifient-elles que l'examen humain est inutile ?

Non, même les outils d'IA les plus performants nécessitent une vérification humaine, en particulier pour les clauses de contrats à haut risque et les citations. L'analyse comparative empirique suggère que certains outils d'IA peuvent égaler ou surpasser les humains sur des tâches de rédaction limitées, mais la précision n'est pas parfaite et le risque varie considérablement selon le cas d'usage.

Quels termes de contrat devraient figurer dans les accords avec les fournisseurs d'IA ?

Incluez des dispositions pour les droits des données, l'allocation de la responsabilité, les restrictions d'entraînement du modèle, l'auditabilité et la conformité aux cadres réglementaires applicables. La conclusion de contrats structurés avec les fournisseurs avec gouvernance au niveau des clauses pour ces questions est une composante reconnue de l'utilisation responsable de l'IA dans la pratique juridique.