Kuinka laatia sopimuksia vastuullisesti tekoälyn avulla

Oikeusalan ammattilaiset ympäri maata huomaavat kovan totuuden: tekoälyn avulla laaditut sopimukset voivat lyhentää työtunteja minuuteiksi, mutta yksittäinen vahvistamaton tuotos voi tuoda virheitä, jotka säilyvät koko sopimuksen laadintaprosessin läpi allekirjoitukseen asti. Eräs yrityksen sisäinen tiimi käytti tekoälytyökalua toimittajasopimuksen laadintaan ja huomasi, että korvausvastuu-lauseke viittasi olemattomaan lakiin. Lauseke läpäisi kaksi sisäistä tarkistusta ennen kuin kumppani huomasi sen. Tämä skenaario ei ole poikkeus. Se on esikatsaus siihen, mitä tapahtuu, kun nopeus ylittää prosessin.

Sisällysluettelo

- Velvollisuuksien ymmärtäminen: pätevyys, luottamuksellisuus ja valvonta

- Valmistelu: vastuullisen tekoälyn avulla laaditun sopimuksen työnkulun rakentaminen

- Sopimuksen laadintaprosessi: vastuullinen tekoälyn integrointi vaihe vaiheelta

- Yleisten riskien vianmääritys ja lieventäminen: hallusinaatiot, poikkeamatapaukset ja vaatimustenmukaisuusvirheet

- Miksi tekoälyn käsittely avustajana, ei oraakkelina, muuttaa tuloksia

- Tutustu vastuullisiin, lähteisiin linkitettyihin tekoälyn sopimuksen laadintaprosesseihin

- Usein kysytyt kysymykset

Tärkeimmät huomiot

| Kohta | Yksityiskohdat | | --- | --- | | Ihmisen vahvistus on välttämätöntä | Käsittele aina tekoälyn laatimat luonnokset vahvistamattomina, kunnes oikeusalan ammattilainen on tarkistanut ne perusteellisesti. | | Ymmärrä oikeudelliset velvollisuudet | Asianajajien on sovellettava pätevyyttä, luottamuksellisuutta ja valvontaa tekoälytyökalujen integroimisessa. | | Tarkasta ja dokumentoi työnkulut | Pidä jäljitettävät tietueet tekoälyn kehotteista, tarkastajista ja sopimuksen muutoksista vaatimustenmukaisuuden ja puolustettavuuden vuoksi. | | Kohdista yleisiin vikapisteisiin | Keskitä tarkistus lainviitteisiin, lakeihin, lainkäyttöalueellisiin lausekkeisiin ja mahdollisiin hallusinaatioihin. | | Strukturoidut sopimukset tekoälyn toimittajien kanssa | Hallitse tietojen käyttöä, riskiä ja tarkastusoikeuksia sopimuksellisesti kolmannen osapuolen tekoälytyökalujen käytössä. |

Velvollisuuksien ymmärtäminen: pätevyys, luottamuksellisuus ja valvonta

Ennen kuin mikään tekoälytyökalu koskettaa sopimusta, oikeusalan ammattilaisten on oltava selvillä siitä, mitä ammatillinen vastuu todella edellyttää. Säännöt eivät ole kirjoitettu uudelleen tekoälylle. Ne on sovellettu siihen.

ABA Formal Opinion 512 kehystää generatiivisen tekoälyn teknologiaksi, jota asianajajien on käytettävä pätevyydellä olemassa olevien velvollisuuksien mukaisesti, mukaan lukien luottamuksellisuus, valvonta ja työtuotteen vahvistus. Tämä kehystys on tärkeä. Se tarkoittaa, että asianajaja, joka ajaa kehotteen ja liittää tuotoksen sopimuksen luonnokseen, on edelleen ammattilainen, joka vastaa jokaisesta sanasta kyseisessä asiakirjassa.

Tekoälyn käytössä sopimuksen laadinnassa sovellettavat keskeiset velvollisuudet sisältävät:

- Pätevyys: Sinun on ymmärrettävä riittävästi, kuinka tekoälytyökalu toimii, jotta voit tunnistaa, milloin se todennäköisesti epäonnistuu, ei vain milloin se onnistuu.

- Luottamuksellisuus: Asiakkaan tiedot, jotka ladataan kolmannen osapuolen tekoälyalustalle, voidaan säilyttää, käyttää mallin koulutukseen tai altistaa tietomurroille. Luottamuksellisuusvelvollisuus edellyttää, että ymmärrät nämä riskit ennen kuin syötät mitään.

- Valvonta: Jos nuorempi asianajaja tai lainopillinen avustaja ajaa tekoälyn avulla laadittuja luonnoksia, valvova asianajaja vastaa tuotoksesta ikään kuin olisi kirjoittanut sen henkilökohtaisesti.

- Vahvistus: Tekoälyn luoma teksti on vahvistamaton luonnos. Piste. Sitä on käsiteltävä näin jokaisessa vaiheessa.

"Asianajajat vastaavat kaikesta työtuotteesta riippumatta siitä, mitä työkalua käytetään sen luomiseen. Generatiivinen tekoäly ei siirrä tai heikennä ammatillista vastuuta."

Firman sisäisen politiikan aloittaminen, joka koodaa nämä velvollisuudet työnkulkuun, ei ole valinnaista. Se on perusta. Alustat, jotka on rakennettu tekoälyn laadintaperiaatteiden ympärille, voivat auttaa tiimejä operationalisoimaan nämä velvollisuudet sen sijaan, että jättäisivät ne abstrakteiksi muistutuksiksi vaatimustenmukaisuuden tarkistuslistalla.

Valmistelu: vastuullisen tekoälyn avulla laaditun sopimuksen työnkulun rakentaminen

Velvollisuuksien tunteminen on lähtökohta. Työnkulun rakentaminen, joka todella pakottaa ne, on vaikeampaa työtä. Useimmat tiimit, jotka joutuvat ongelmiin tekoälyn avulla laadittujen sopimusten kanssa, eivät epäonnistu, koska he jättivät huomiotta etiikan säännöt. He epäonnistuvat, koska he eivät koskaan muuntaneet näitä sääntöjä konkreettisiksi prosessin vaiheiksi.

Vastuullisen sopimuksen laadintatyönkulun tulisi operationalisoida tarkistusportit: käsitellä tekoälyn tekstiä vahvistamattomina luonnoksina ja vaatia ihmisen vahvistus ennen julkaisua tai käyttöä. Se ei ole ehdotus. Se on puolustettavan käytännön vähimmäisstandardi.

Ennen kuin tiimisi laatii yhtä tekoälyn avulla laadittua sopimusta, käy läpi tämä valmistelun tarkistuslista:

- Politiikkakerros: Laadi ja hyväksy sisäinen tekoälyn käyttöpolitiikka, joka määrittää, mitkä työkalut on hyväksytty, mitä tietoja voidaan jakaa ja kuka on valtuutettu käyttämään tekoälyä mihin tehtäviin.

- Työkalujen valinta: Valitse alustat, jotka tarjoavat lähteen seurannan, tarkistuslokit, pääsynvalvonnan ja selkeät tietojen säilytysperiaatteet. Vältä työkaluja, jotka eivät voi kertoa, mistä lauseke tuli.

- Toimittajasopimukset: Vastuullinen käyttö voi sisältää strukturoitua sopimusta tekoälyn toimittajien kanssa ja lauseke-tason hallintaa mallin koulutukselle, tietojen oikeuksille, vastuulle ja tarkastettavuudelle. Jos tekoälyn toimittajasopimuksesi ei käsittele näitä kohtia, neuvottele ne ennen kuin aloitat.

- Roolien määritys: Määritä, kuka luo tekoälyn luonnoksia, kuka tarkistaa ne ja kuka on lopullisen hyväksynnän auktoriteetti. Näiden tulisi olla eri henkilöt.

- Koulutus: Jokaisen tekoälytyökaluja käyttävän tiimin jäsenen tulisi ymmärtää yleiset vikamuodot, erityisesti hallusinaatiot, ennen kuin he käyttävät alustaa aktiivisissa asioissa.

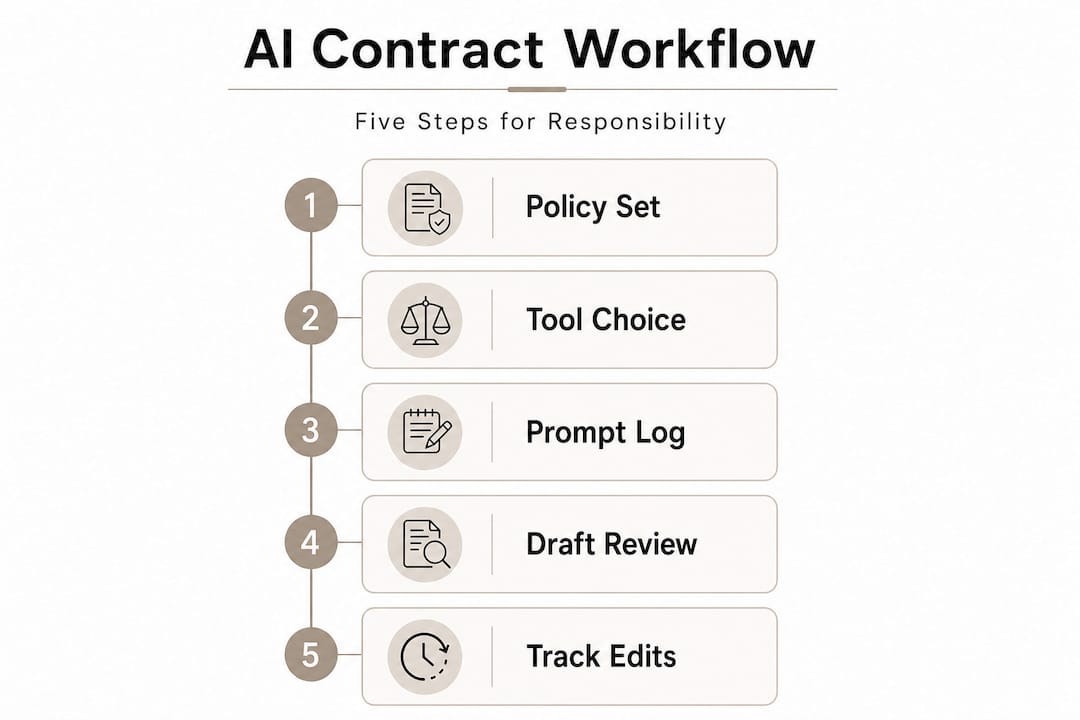

Tässä on käytännöllinen yleiskatsaus siitä, miltä hallittu tekoälyn laadintatyönkulku näyttää keskeisten ulottuvuuksien yli:

| Ulottuvuus | Mitä käsitellä | Tarkistuspiste | |---|---|---| | Työkalujen valinta | Lähteen seuranta, yksityisyys, tarkistuslokit | Ennen käyttöönottoa | | Kehotteen suunnittelu | Tarkkuus, lainkäyttöalue, lauseketyyppi | Ennen luomista | | Tuotoksen tarkistus | Tarkkuus, lainviitteet, oikeudellinen soveltuvuus | Luomisen jälkeen | | Toimittajasopimus | Tietojen oikeudet, vastuu, mallin koulutus | Ennen sopimuksen allekirjoitusta | | Tarkistuslokit | Kehotukset, tarkastajat, tulokset | Jatkuva |

Pro-vinkki: Pidä juoksevaa lokia jokaisesta tekoälyn avulla laaditusta sopimuksen tehtävästä, mukaan lukien käytetty kehotus, määritetty tarkastaja ja vahvistustarkistuksen tulos. Tämä loki on paras puolustuksesi, jos asiakas tai sääntelyviranomainen koskaan kyseenalaistaa prosessiasi. Se myös rakentaa institutionaalista tietoa siitä, mitkä kehotuskuviot tuottavat luotettavia tuloksia ja mitkä vaativat tarkennusta.

Tekoälyn hallinnon rakentaminen oikeusalan työnkulkuihin alusta alkaen vaatii ponnistelua, mutta se maksaa itsensä takaisin ensimmäisen kerran, kun sopimuskiista syntyy ja voit osoittaa selkeän, dokumentoidun ihmisen valvonnan ketjun.

Sopimuksen laadintaprosessi: vastuullinen tekoälyn integrointi vaihe vaiheelta

Valmistelu on valmis. Nyt varsinainen laadintatyö alkaa. Alla olevat vaiheet kuvastavat prosessia, joka on sekä tehokas että puolustettava. Vaiheiden ohittaminen, erityisesti vahvistusportit, on se, missä tiimit joutuvat ongelmiin.

- Määritä laajuus. Ennen kuin avaat mitään tekoälytyökalua, dokumentoi sopimuksen tyyppi, sovellettava laki, lainkäyttöalue, pääosapuolet ja kaikki epätyypilliset ehdot. Tämä laajuusasiakirja muodostaa perustan kehotuksellesi ja tarkistuslistallesi.

- Valitse malli tai ennakkotapaus. Tekoäly toimii paremmin, kun se työskentelee tunnetusta rakenteesta. Aloita yrityksen hyväksymällä mallilla tai lainkäyttöalueelle spesifisellä ennakkotapauksella. Syötä tämä konteksti tekoälyyn sen sijaan, että pyytäisit sitä luomaan tyhjästä.

- Laadi strukturoitu kehotus. Määritä sovellettava laki, lainkäyttöalue, lauseketyyppi ja kaikki erityiset velvollisuudet tai poikkeamat. Epäselvät kehotukset tuottavat epäselviä sopimuksia.

- Luo luonnos. Aja kehotus ja kaappaa koko tuotos, mukaan lukien kaikki lähdeviitteet, jotka työkalu tarjoaa. Älä muokkaa vielä.

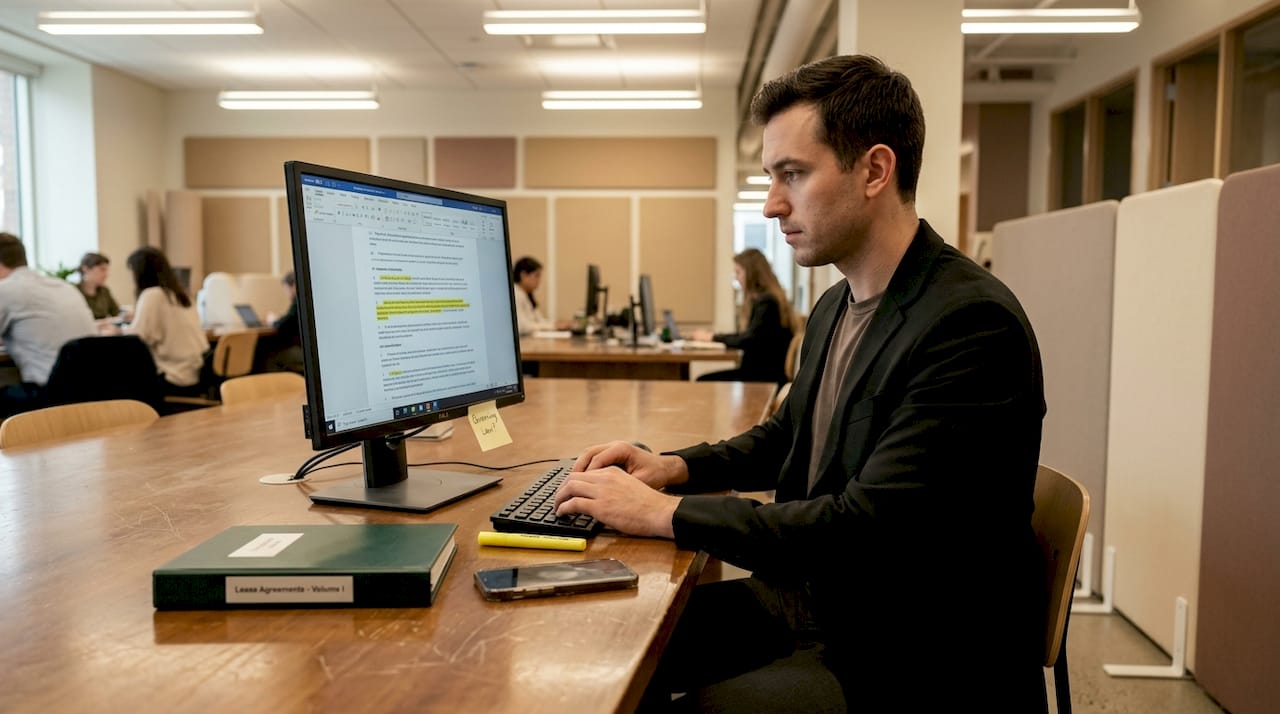

- Ihmisen tarkistusportti. Pätevä tarkastaja lukee koko luonnoksen laajuusasiakirjaa vastaan. Tämä ei ole pintapuolinen silmäily. Se on rivi riviltä tapahtuva tarkistus alkuperäisen mallin kanssa avoimena.

- Vahvistusläpikäynti. Jokainen lainviite, tapaus tai sääntelyviite vahvistetaan itsenäisesti ensisijaisista lähteistä. Jokainen lainkäyttöalueellinen väite tarkistetaan. Jokainen määritelty termi vahvistetaan johdonmukaisuuden osalta.

- Julkaisu tai palautus tarkistukseen. Jos luonnos läpäisee vahvistuksen, se etenee. Jos se epäonnistuu, se palautetaan kohdennettuun tarkistukseen, ei uuteen tekoälyn luomiseen ymmärtämättä, mikä meni pieleen.

Empiirinen vertailuanalyysi viittaa siihen, että jotkut tekoälytyökalut voivat vastata tai ylittää ihmisiä rajoitetuissa laadintatehtävissä, mutta ihmisen vahvistus on edelleen välttämätöntä, koska tarkkuus ei ole täydellinen ja riski vaihtelee merkittävästi käyttötapauksen mukaan. Korkean suorituskyvyn tekoäly vakio-NDA:ssa ei ole sama kuin korkean suorituskyvyn tekoäly rajat ylittävässä hankintasopimuksessa, jossa on monijurisdiktionaalisia sääntelyhakoja.

Tässä on, kuinka kolme laadintamenetelmää vertautuvat keskeisten riski- ja tehokkuusulottuvuuksien yli:

| Tekijä | Manuaalinen laadinta | Tekoälyn avulla laadittu, ei vahvistusta | Tekoälyn avulla laadittu vahvistuksella | |---|---|---|---| | Nopeus | Hidas | Nopea | Kohtalainen | | Lainviitteen tarkkuus | Korkea | Vaihteleva | Korkea | | Hallusinaatioriskit | Ei mitään | Korkea | Matala | | Puolustettavuus | Korkea | Matala | Korkea | | Tehokkuuden parannus | Perusviiva | Korkea mutta riskialtis | Merkittävä ja turvallinen |

Keskimmäinen sarake on ansa. Tiimit, jotka ottavat tekoälyn käyttöön nopeuden vuoksi mutta ohittavat vahvistuksen, saavat molempien maailmojen pahimman: nopeat luonnokset piilotettujen virheiden kanssa ja ei tarkistuspolkua, joka osoittaisi, että he tarkistivat.

Pro-vinkki: Käytä strukturoituja kehotuksia, jotka määrittävät tarkan lauseketyyppin, sovellettavan lain ja kaikki sovellettavat sääntelykehykset. Esimerkiksi: "Laadi rajoitetun vastuun lauseke, jota sovelletaan New Yorkin lain mukaan ohjelmistopalvelun sopimukseen kahden kaupallisen yksikön välillä, poissulkien välilliset vahingot." Tämä tarkkuuden taso tuottaa tuotoksia, jotka on paljon helpompi vahvistaa luotettavaa sopimuksen laadintatyönkulkua vastaan.

Yleisten riskien vianmääritys ja lieventäminen: hallusinaatiot, poikkeamatapaukset ja vaatimustenmukaisuusvirheet

Jopa hyvin suunnitellut työnkulut kohtaavat ongelmia. Tavoite ei ole poistaa kaikkea tekoälyvirhettä, mikä ei ole tällä hetkellä mahdollista. Tavoite on saada virheet kiinni ennen kuin ne ovat tärkeitä.

Tekoälyn avulla laadittujen sopimusten yleisimmät vikamuodot sisältävät:

- Hallusinoituja lainviitteitä: Tekoäly keksii lain, tapauksen tai sääntelyviitteen, jota ei ole olemassa, tai viittaa todelliseen lähteeseen väitteelle, jota se ei todella tue.

- Sekoitettuja oikeudellisia käsitteitä: Tekoäly yhdistää standardeja eri lainkäyttöalueista tai oikeudellisista kehyksistä, tuottaen lausekkeen, joka näyttää johdonmukaiselta mutta soveltaa väärää oikeudellista testia.

- Lainkäyttöalueen epäsuhta: Tekoäly soveltaa oletusarvoja yhdestä oikeusjärjestelmästä (usein liittovaltion tai common law) sopimukseen, joka vaatii osavaltiokohtaista tai siviilioikeudellista käsittelyä.

- Vanhentunut auktoriteetti: Tekoäly viittaa lakiin, jota on muutettu, tai tapaukseen, joka on kumottu, koska sen koulutustiedoilla on katkaisupäivä.

- Epäjohdonmukaiset määritellyt termit: Tekoäly käyttää samaa termiä hieman eri merkityksillä saman sopimuksen eri osissa.

Poikkeamatapaukset, jotka yleisesti rikkovat tekoälyn avulla laadittuja sopimuksia, sisältävät lainkäyttöaluekohtaiset lausekkeet, lainviitteen tarkkuuden ja hallusinoituja auktoriteeteja. Vastuulliset työnkulut nimenomaisesti kohdistuvat näihin vikamuotoihin sen sijaan, että toivoisivat niiden olevan ilmestymättä.

"Älä koskaan luota, aina vahvista." NCSC AI Hallusinaation opas tunnistaa hallusinaatiot, kuten väärennetyt lainviitteet, vääristyneet ratkaisut, väärät menettelytiedot ja sekoitetut oikeudelliset käsitteet kategorioiksi, jotka vaativat systemaattista ihmisen vahvistusta, ei pistokoeotantaa.

Tekoälyn luomien sopimuksen tuotosten tehokkaaksi tarkastamiseksi noudata tätä järjestystä:

Ensin, aja jokainen lakiviite nykyistä versiota vastaan asiaankuuluvasta säännöstöstä. Älä oleta, että tekoälyllä on oikea pykälän numero. Toiseksi, vahvista jokainen tapausviite vetämällä todellinen päätös ja vahvistamalla väite, jonka tekoäly sille antoi. Kolmanneksi, vertaa lainkäyttöalueen oletuksia luonnoksessa hallintosäännön lausekkeeseen. Neljänneksi, tarkista määritellyt termit sisäisen johdonmukaisuuden osalta koko asiakirjassa. Viidenneksi, merkitse mikä tahansa lauseke, jota tarkastaja ei voi itsenäisesti vahvistaa ensisijaista lähdettä vastaan.

Pro-vinkki: Arkaluonteisissa asioissa säilytä kehotuslokit ja tarkistustietueet osana asiakastiedostoa. Jos sopimusta myöhemmin kiistetään ja vastapuoli kyseenalaistaa, käyttitkö tekoälyä vastuullisesti, tarkistuspolkusi on todiste siitä, että ammatilliset standardit täytettiin. Tämä on myös hyvä käytäntö sopimuksen vahvistusstrategioille, jotka kestävät sääntelytarkastuksen.

Missattujen virheiden oikeudelliset ja maineriiskit eivät ole hypoteettisia. Väärennetty laki hallintosäännön lausekkeessa voi tehdä säännöksestä täytäntöönpanokelvoton. Lainkäyttöalueen epäsuhta lain valintaa koskevan lausekkeen kanssa voi altistaa asiakkaan oikeudenkäynnille odottamattomassa foorumissa. Nämä eivät ole poikkeamatapauksia. Ne ovat tekoälyn tuotoksen käsittelyn ennustettavat tulokset valmiina työnä.

Miksi tekoälyn käsittely avustajana, ei oraakkelina, muuttaa tuloksia

Tässä on epämiellyttävä todellisuus, jota useimmat tekoälyn käyttöönottokeskustelut oikeusalan käytännössä välttävät: tekoälyn tuotoksen luottamus ei korreloi sen tarkkuuden kanssa. Tekoälytyökalu ilmoittaa väärennetyn lain täsmälleen samalla sävy- ja muodolla kuin todellisen. Se sekoittaa kaksi yhteensopimattomia oikeudellista standardia ilman mitään osoitusta siitä, että jotain on vialla. Tämä pintapuolinen luottamus on todellinen vaara, ei itse työkalu.

Puolustettava lähestymistapa on tekoälyn käsittely laadintavustajana, ei oikeudellisena oraakkelina. Tämä kehystys vaatii pätevyyttä, luottamuksellisuutta, valvontaa ja vahvistusportteja prosessin jokaisessa vaiheessa.

Vallitseva viisaus oikeusalan tekniikkapiireissä on, että tekoälyn käyttöönotto on ensisijaisesti muutoksen hallintaongelma. Saa asianajajat mukavaksi työkalujen kanssa, ja loput seuraavat. Tämä kehystys on väärä tietyllä ja tärkeällä tavalla. Mukavuus tekoälytyökalujen kanssa ilman strukturoitua vahvistusta ei ole edistystä. Se on riskin kertymistä mittakaavassa.

Tiimit, jotka saavat eniten kestävää arvoa tekoälyn avulla laaditusta sopimuksesta, eivät ole niitä, jotka käyttävät tekoälyä eniten. He ovat niitä, jotka ovat rakentaneet selkeimmät prosessit sille, milloin tekoälyn tuotokseen voidaan luottaa ja milloin se on ohitettava. He käsittelevät jokaista tekoälyn laadittua luonnosta lähtökohtana, jonka on kirjoittanut erittäin nopea, erittäin itsevarma ja toisinaan väärässä nuorempi asianajaja. Tämä mentaalimalli pitää asianajajan vahvistusroolissa passiivisen hyväksymisroolin sijaan.

Praktinen kurinalaisuus, jonka arvoista rakentaa tiimisi kulttuuriin, on sopimuksen jälkianalyysi. Kun tekoälyn avulla laadittu sopimus paljastaa virheen tarkistuksen aikana tai pahempaa, allekirjoituksen jälkeen, dokumentoi, mitä tapahtui. Mitä kehotusta käytettiin? Mikä tarkistusvaihe jätti huomaamatta virheen? Mikä olisi saaneet sen kiinni aikaisemmin? Nämä oppitunnit, kerättyinä ajan myötä, muuttavat yleisen tekoälytyönkulun yrityskohtaiseksi, jatkuvasti parantuvaksi vastuullisen tekoälyn laadintanäkökulmaksi.

Tiimit, jotka ohittavat jälkianalyysit, ovat niitä, jotka toistavat samoja virheitä. Tiimit, jotka institutionalisoivat ne, rakentavat todellisen kilpailuedun laadun ja puolustettavuuden suhteen.

Tutustu vastuullisiin, lähteisiin linkitettyihin tekoälyn sopimuksen laadintaprosesseihin

Näiden periaatteiden johdonmukainen soveltaminen vaatii enemmän kuin hyviä aikomuksia. Se vaatii alustaa, joka on rakennettu niiden tukemiseksi.

Jarel on rakennettu erityisesti oikeusalan ammattilaisille, jotka tarvitsevat tekoälyn apua, joka pysyy yhteydessä lähteisiinsä. Jokainen Jarelin työtilan tuotos on linkitetty taustalla olevaan sopimuksen kieleen, lakiin tai oikeuskäytäntöön, joka siihen vaikutti, joten tarkistusprosessillasi on jotain konkreettista vahvistettavaksi. Alusta sisältää tarkistuslokit, pääsynvalvonnan ja tarkistuspolut, jotka tekevät tässä artikkelissa kuvatusta hallitusta työnkulusta käytännöllisen sen sijaan, että se olisi teoreettinen. Tiimeille, jotka ovat valmiita siirtymään ad hoc -tekoälyn käytöstä strukturoituun, vaatimuksenmukaiseen laadintaprosessiin, Jarelin vastuullinen tekoälyalusta tarjoaa infrastruktuurin tehdä se oikein.

Usein kysytyt kysymykset

Mikä on suurin riski tekoälyn käytössä sopimuksen laadinnassa?

Pääriski on luottaa tekoälyn luomaan sisältöön ilman ihmisen vahvistusta, mikä voi johtaa hallusinoituihin lainviitteisiin tai tosiseikkoihin, jotka pääsevät allekirjoitettuihin sopimuksiin. NCSC kuvaa hallusinaatiokategorioita, mukaan lukien väärennetyt tapausviitteet, vääristyneet ratkaisut, väärät menettelytiedot ja sekoitetut oikeudelliset käsitteet lainkäyttöalueilla.

Ovatko asianajajat sallittuja käyttämään tekoälyä ABA-mallin sääntöjen mukaisesti?

Kyllä, asianajajat voivat käyttää tekoälyä, jos he ylläpitävät pätevyyttä, luottamuksellisuutta, valvontaa ja asianmukaista vahvistusta työtuotteesta. ABA Formal Opinion 512 kehystää generatiivisen tekoälyn teknologiaksi, jota asianajajien on käytettävä pätevyydellä olemassa olevien ammatillisten velvollisuuksien mukaisesti.

Tarkoittavatko tekoälyn vertailuanalyysit, että ihmisen tarkistus on tarpeeton?

Ei, jopa parhaiten suoriutuvat tekoälytyökalut vaativat ihmisen vahvistusta, erityisesti korkean riskin sopimuksen lausekkeille ja lainviitteille. Empiirinen vertailuanalyysi viittaa siihen, että jotkut tekoälytyökalut voivat vastata tai ylittää ihmisiä rajoitetuissa laadintatehtävissä, mutta tarkkuus ei ole täydellinen ja riski vaihtelee merkittävästi käyttötapauksen mukaan.

Mitä sopimuksen ehtoja tulisi sisältyä tekoälyn toimittajasopimuksiin?

Sisällytä määräykset tietojen oikeuksista, vastuun jaosta, mallin koulutuksen rajoituksista, tarkastettavuudesta ja vaatimustenmukaisuudesta sovellettavien sääntelykehysten kanssa. Strukturoitu sopiminen tekoälyn toimittajien kanssa, jossa on lauseke-tason hallinta näille asioille, on tunnustettu osa vastuullisen tekoälyn käyttöä oikeusalan käytännössä.