Sådan udarbejder du kontrakter ansvarligt med AI-assistance

Juridiske teams rundt omkring landet opdager en hård sandhed: AI-assisteret kontraktudarbejdelse kan reducere timers arbejde til minutter, men et enkelt uverificeret output kan introducere fejl, der overlever hele vejen til underskrift. Et internt juridisk team stolede for nylig på et AI-værktøj til at generere en leverandøraftale, kun for at opdage, at erstatningsklausulen citerede en lov, der ikke eksisterede. Klausulen passerede to interne gennemgange, før en partner opdagede det. Dette scenarie er ikke en undtagelse. Det er en forhåndsvisning af, hvad der sker, når hastighed overgår proces.

Indholdsfortegnelse

- Forståelse af dine pligter: kompetence, fortrolighed og tilsyn

- Forberedelse: opbygning af en arbejdsgang for ansvarlig AI-kontraktudarbejdelse

- Kontraktudarbejdelsesprocessen: ansvarlig AI-integration trin for trin

- Fejlfinding og risikobegrænsning: hallucinationer, kanttilfælde og compliance-fejl

- Hvorfor behandling af AI som assistent, ikke orakel, ændrer resultater

- Udforsk ansvarlig, kildelinket AI-kontraktarbejdsgang

- Ofte stillede spørgsmål

Vigtige takeaways

| Punkt | Detaljer | | --- | --- | | Menneskelig verifikation er vigtig | Behandl altid AI-genererede udkast som uverificerede, indtil de er grundigt gennemgået af en juridisk ekspert. | | Forstå juridiske pligter | Advokater skal anvende kompetence, fortrolighed og tilsyn ved integration af AI-værktøjer. | | Revision og dokumentation af arbejdsgange | Vedligehold sporbare optegnelser over AI-prompts, anmeldere og kontraktændringer for compliance og forsvarbarhed. | | Målret almindelige fejlpunkter | Fokuser gennemgang på citater, love, jurisdiktionsklausuler og mulige hallucinationer. | | Strukturerede kontrakter med AI-leverandører | Styr datakontrol, risiko og revisionsrettigheder kontraktligt ved brug af AI-værktøjer fra tredjeparter. |

Forståelse af dine pligter: kompetence, fortrolighed og tilsyn

Før et AI-værktøj rører en kontrakt, skal juridiske fagfolk være klare over, hvad professionelt ansvar faktisk kræver. Reglerne er ikke blevet omskrevet for AI. De er blevet anvendt på det.

ABA Formal Opinion 512 præsenterer generativ AI som en teknologi, som advokater skal bruge kompetent under eksisterende pligter, herunder fortrolighed, tilsyn og verifikation af arbejdsprodukt. Denne præsentation betyder noget. Det betyder, at advokaten, der kører en prompt og indsætter outputtet i et kontraktudkast, stadig er den fagperson, der er ansvarlig for hvert ord i det dokument.

De centrale pligter, der gælder ved brug af AI i kontraktudarbejdelse, omfatter:

- Kompetence: Du skal forstå nok om, hvordan AI-værktøjet fungerer, til at identificere, hvornår det sandsynligvis fejler, ikke blot hvornår det lykkes.

- Fortrolighed: Klientdata uploadet til en AI-platform fra tredjeparter kan blive bevaret, brugt til modeltraining eller udsættes for brud. Fortrolighedspligt kræver, at du forstår disse risici, før du inputter noget.

- Tilsyn: Hvis en junior advokat eller juridisk assistent kører AI-assisterede udkast, er den vejledende advokat ansvarlig for outputtet, som hvis de havde skrevet det personligt.

- Verifikation: AI-genereret tekst er et uverificeret udkast. Punkt. Det skal behandles sådan på hvert trin.

"Advokater forbliver ansvarlige for alt arbejdsprodukt, uanset hvilket værktøj der bruges til at generere det. Generativ AI overfører eller svækker ikke professionelt ansvar."

At starte med en intern firmapolitik, der kodificerer disse pligter i din arbejdsgang, er ikke valgfrit. Det er fundamentet. Platforme bygget omkring AI-udarbejdelsesprincipper kan hjælpe teams med at operationalisere disse forpligtelser i stedet for at lade dem være abstrakte påmindelser på en compliance-tjekliste.

Forberedelse: opbygning af en arbejdsgang for ansvarlig AI-kontraktudarbejdelse

At kende dine pligter er udgangspunktet. At bygge en arbejdsgang, der faktisk håndhæver dem, er det sværere arbejde. De fleste teams, der løber ind i problemer med AI-assisteret udarbejdelse, fejler ikke, fordi de ignorerede etik-regler. De fejler, fordi de aldrig oversatte disse regler til konkrete processtrin.

En ansvarlig kontraktudarbejdelsesarbejdsgang bør operationalisere gennemgangsporte: behandle AI-tekst som uverificerede udkast og kræve menneskelig verifikation før frigivelse eller afhængighed. Det er ikke et forslag. Det er minimumsstandarden for forsvarlig praksis.

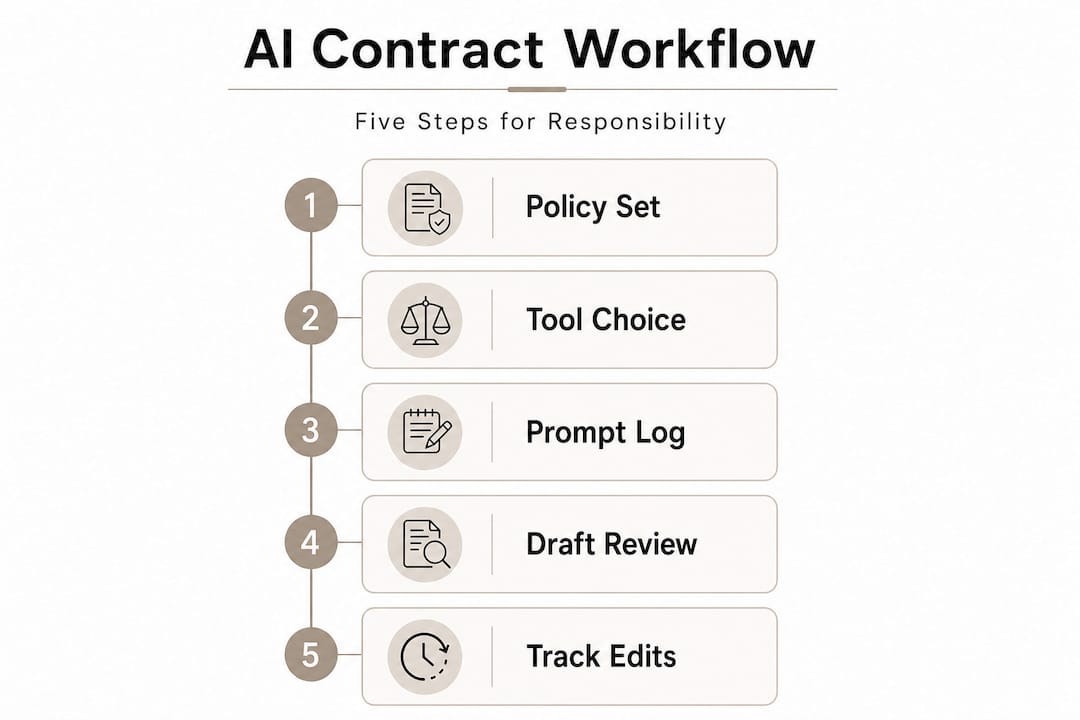

Før dit team udarbejder en enkelt AI-assisteret kontrakt, arbejd gennem denne forberedelsestjekliste:

- Politiklag: Udarbejd og vedtag en intern AI-brugspolitik, der specificerer, hvilke værktøjer der er godkendt, hvilke data der kan deles, og hvem der er autoriseret til at bruge AI til hvilke opgaver.

- Værktøjsvalg: Vælg platforme, der tilbyder kildesporing, revisionslogger, adgangskontrol og klare dataopbevaringspolitikker. Undgå værktøjer, der ikke kan fortælle dig, hvor en klausul kommer fra.

- Leverandøraftaler: Ansvarlig brug kan omfatte struktureret leverandørkontrakter og klausuleniveaustyring for modeltraining, datarettigheder, ansvar og revisionsevne. Hvis din AI-leverandøraftale ikke behandler disse punkter, forhandler dem, før du går live.

- Rolletildelinger: Udpeg hvem der genererer AI-udkast, hvem der gennemgår dem, og hvem der har endelig godkendelsesmyndighed. Disse bør være forskellige personer.

- Træning: Alle teammedlemmer, der bruger AI-værktøjer, bør forstå almindelige fejltilstande, især hallucinationer, før de bruger platformen på live-sager.

Her er et praktisk overblik over, hvad en styret AI-udarbejdelsesarbejdsgang ser ud på tværs af vigtige dimensioner:

| Dimension | Hvad der skal behandles | Gennemgangsport | |---|---|---| | Værktøjsvalg | Kildesporing, privatlivsbeskyttelse, revisionslogger | Før onboarding | | Prompt-design | Specificitet, jurisdiktion, klausultype | Før generering | | Output-gennemgang | Nøjagtighed, citater, juridisk pasform | Efter generering | | Leverandørkontakt | Datarettigheder, ansvar, modeltraining | Før kontraktsignering | | Revisionsoptegnelser | Prompts, anmeldere, resultater | Løbende |

Pro Tip: Vedligehold en løbende log over hver AI-assisteret kontraktopgave, herunder den brugte prompt, den tildelte anmelder og resultatet af verifikationstjekket. Denne log er dit bedste forsvar, hvis en klient eller regulator nogensinde stiller spørgsmål ved din proces. Det bygger også institutionel viden om, hvilke prompt-mønstre der producerer pålidelige resultater, og hvilke der har brug for raffinement.

At bygge AI-styring i juridiske arbejdsgange fra bunden tager indsats, men det betaler sig første gang en kontrakttvist opstår, og du kan vise en klar, dokumenteret kæde af menneskelig tilsyn.

Kontraktudarbejdelsesprocessen: ansvarlig AI-integration trin for trin

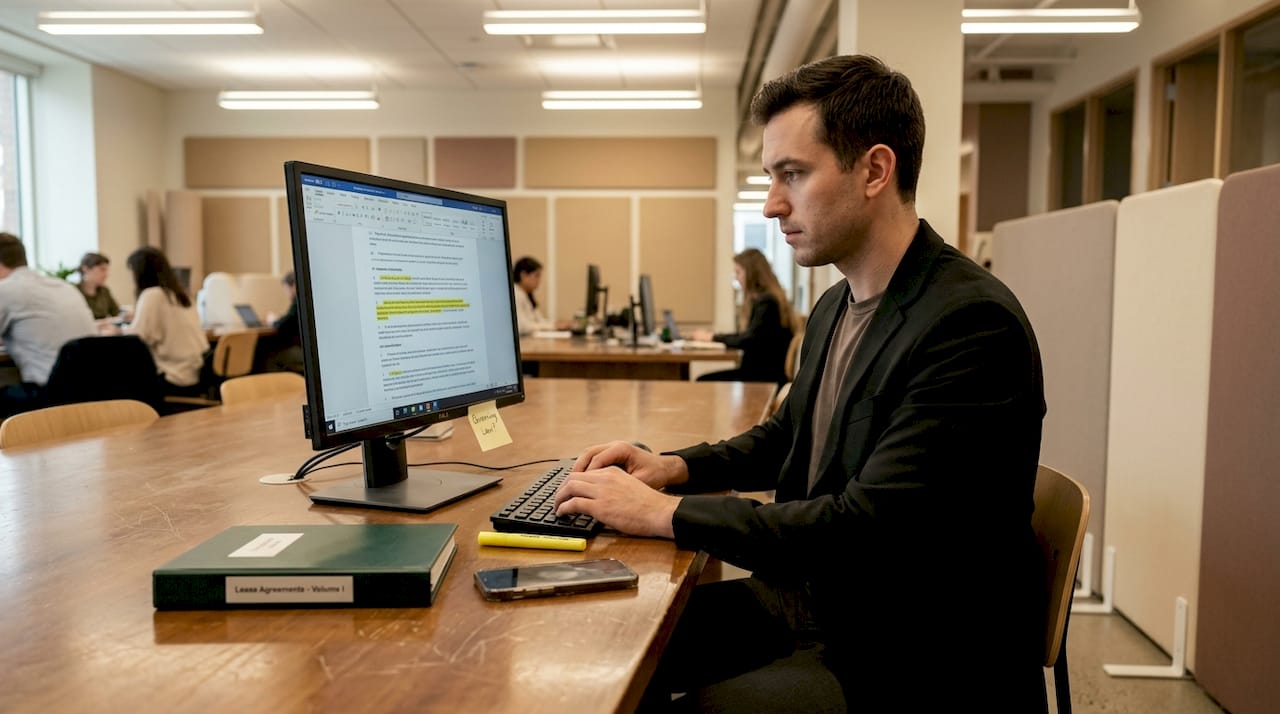

Forberedelse er fuldført. Nu begynder det faktiske udarbejdelsesarbejde. Trinene nedenfor afspejler en proces, der er både effektiv og forsvarlig. At springe trin over, især verifikationsportene, er hvor teams løber ind i problemer.

- Definer omfanget. Før du åbner et AI-værktøj, dokumenter kontrakttypen, gældende lov, jurisdiktion, vigtige parter og eventuelle ikke-standardbetingelser. Dette omfangsdokument bliver grundlaget for din prompt og din gennemgangstjekliste.

- Vælg en skabelon eller præcedens. AI fungerer bedre, når det arbejder fra en kendt struktur. Start med en firmagodkendt skabelon eller en jurisdiktionsspecifik præcedens. Føj denne kontekst ind i AI i stedet for at bede det generere fra bunden.

- Udarbejd en struktureret prompt. Specificer gældende lov, jurisdiktion, klausultype og eventuelle specifikke forpligtelser eller undtagelser. Vage prompts producerer vage kontrakter.

- Generer udkastet. Kør prompten og indfang det fulde output, herunder eventuelle kildehenvisninger værktøjet giver. Rediger ikke endnu.

- Menneskelig gennemgangsport. En kvalificeret anmelder læser hele udkastet mod omfangsdokumentet. Dette er ikke en hurtig gennemgang. Det er en linje-for-linje gennemgang med den oprindelige skabelon åben til sammenligning.

- Verifikationspass. Hver citeret lov, sag eller regulatorisk henvisning verificeres uafhængigt mod primære kilder. Hver jurisdiktionskrav kontrolleres. Hver defineret term bekræftes for konsistens.

- Frigivelse eller returnering til revision. Hvis udkastet passerer verifikation, bevæger det sig fremad. Hvis det fejler, går det tilbage til målrettet revision, ikke en frisk AI-generering uden at forstå, hvad der gik galt.

Empirisk benchmarking tyder på, at nogle AI-værktøjer kan matche eller overgå mennesker på begrænsede udarbejdelsesopgaver, men menneskelig verifikation forbliver nødvendig, fordi nøjagtighed ikke er perfekt, og risiko varierer betydeligt efter use case. En højtydende AI på en standard NDA er ikke det samme som en højtydende AI på en grænseoverskridende opkøbsaftale med multi-jurisdiktionelle regulatoriske forbindelser.

Her er, hvordan de tre udarbejdelsestilgange sammenligner på tværs af vigtige risiko- og effektivitetsdimensioner:

| Faktor | Manuel udarbejdelse | AI-assisteret, ingen verifikation | AI-assisteret med verifikation | |---|---|---|---| | Hastighed | Langsom | Hurtig | Moderat | | Citatnøjagtighed | Høj | Variabel | Høj | | Hallucinationsrisiko | Ingen | Høj | Lav | | Forsvarbarhed | Høj | Lav | Høj | | Effektivitetsgevinst | Baseline | Høj men risikabel | Betydelig og sikker |

Midterkolonnen er fælden. Teams, der adopterer AI for hastighed, men springer verifikation over, får det værste fra begge verdener: hurtige udkast med skjulte fejl og ingen revisionssti til at vise, at de kontrollerede.

Pro Tip: Brug strukturerede prompts, der specificerer den nøjagtige klausultype, gældende lov og eventuelle regulatoriske rammer, der gælder. For eksempel: "Udarbejd en ansvarsbegrænsningsklausul reguleret af New York-loven for en software-as-a-service-aftale mellem to kommercielle enheder, eksklusive følgeskader." Dette niveau af specificitet producerer outputs, der er langt lettere at verificere mod en pålidelig kontraktudarbejdelsesarbejdsgang.

Fejlfinding og risikobegrænsning: hallucinationer, kanttilfælde og compliance-fejl

Selvom veldesignede arbejdsgange støder på problemer. Målet er ikke at eliminere al AI-fejl, hvilket ikke er muligt i øjeblikket. Målet er at fange fejl, før de betyder noget.

De mest almindelige fejltilstande i AI-assisteret kontraktudarbejdelse omfatter:

- Hallucinererede citater: AI opfinder en lov, sag eller regulatorisk henvisning, der ikke eksisterer, eller citerer en reel kilde for en proposition, den faktisk ikke understøtter.

- Blandede juridiske begreber: AI fusionerer standarder fra forskellige jurisdiktioner eller juridiske rammer, hvilket producerer en klausul, der ser sammenhængende ud, men anvender den forkerte juridiske test.

- Jurisdiktionsmismatches: AI anvender standardantagelser fra ét retssystem (ofte føderalt eller common law) på en kontrakt, der kræver statsspecifik eller civilretlig behandling.

- Forældet autoritet: AI citerer en lov, der er blevet ændret, eller en sag, der er blevet omstødt, fordi dens træningsdata har en skæringsdato.

- Inkonsistente definerede termer: AI bruger samme term med lidt forskellige betydninger på tværs af forskellige sektioner af samme kontrakt.

Kanttilfælde, der almindeligvis bryder AI-assisteret udarbejdelse, omfatter jurisdiktionsspecifikke klausuler, citatnøjagtighed og hallucinereret autoritet. Ansvarlige arbejdsgange målretter eksplicit disse fejltilstande i stedet for at håbe, de ikke vises.

"Stol aldrig, verificer altid." NCSC AI Hallucination Guide identificerer hallucinationer såsom fabrikerede citater, forvrængede holdninger, falsk proceduremæssig information og blandede juridiske begreber som kategorier, der kræver systematisk menneskelig verifikation, ikke stikprøvekontrol.

For at revidere AI-genererede kontraktoutput effektivt, følg denne sekvens:

Kør først hvert lovstatut-citat mod den aktuelle version af den relevante kode. Antag ikke, at AI har det rigtige sektionsnummer. For det andet verificer hvert sagscitat ved at trække den faktiske afgørelse og bekræfte den proposition, AI tilskrev det. For det tredje sammenlign jurisdiktionsantagelser i udkastet mod klausulen om gældende lov. For det fjerde kontroller definerede termer for intern konsistens på tværs af hele dokumentet. For det femte flag enhver klausul, som anmelderen ikke kan verificere uafhængigt mod en primær kilde.

Pro Tip: For følsomme sager, bevar dine prompt-logger og gennemgangsoptegnelser som del af sagsmappen. Hvis en kontrakt senere bliver bestridt, og modstander stiller spørgsmål ved, om AI blev brugt ansvarligt, er din revisionssti beviset for, at professionelle standarder blev opfyldt. Dette er også god praksis for kontraktverifikationsstrategier, der holder under regulatorisk kontrol.

De juridiske og omdømmemæssige risici ved oversete fejl er ikke hypotetiske. En fabrikeret lov i en gældende lovklausul kan gøre en bestemmelse uigennemtvingelig. En jurisdiktionsmismatch i en lovvalgsklausul kan udsætte en klient for retssager på et uventet forum. Disse er ikke kanttilfælde. De er de forudsigelige resultater af at behandle AI-output som færdigt arbejde.

Hvorfor behandling af AI som assistent, ikke orakel, ændrer resultater

Her er den ubehagelige virkelighed, som de fleste AI-adoptionssamtaler i juridisk praksis undgår: AI-outputtets selvtillid er ikke korreleret med dets nøjagtighed. Et AI-værktøj vil angive en fabrikeret lov i nøjagtigt samme tone og format som en rigtig. Det vil blande to uforenelige juridiske standarder uden nogen indikation af, at noget er galt. Denne overfladiske selvtillid er den faktiske fare, ikke værktøjet selv.

En forsvarlig tilgang er at behandle AI som en udarbejdelsesassistent, ikke en juridisk orakel. Denne ramme kræver kompetence, fortrolighed, tilsyn og verifikationsporte på hvert trin af processen.

Den konventionelle visdom i juridiske tech-kredse er, at AI-adoption primært er et ændringsledelsesproblem. Få advokater komfortable med værktøjerne, og resten følger. Denne ramme er forkert på en specifik og vigtig måde. Komfort med AI-værktøjer uden struktureret verifikation er ikke fremskridt. Det er risikoansamling i stor skala.

De teams, der får mest bæredygtig værdi fra AI-assisteret udarbejdelse, er ikke dem, der bruger AI mest. De er dem, der har bygget de klareste processer for, hvornår man skal stole på AI-output, og hvornår man skal tilsidesætte det. De behandler hvert AI-genereret udkast som et udgangspunkt skrevet af en meget hurtig, meget selvsikker og lejlighedsvis forkert junior assistent. Denne mentale model holder advokaten i verifikationsrollen i stedet for den passive godkendelsesrolle.

En praktisk disciplin værd at bygge ind i dit teams kultur er kontraktobduktionen. Når en AI-assisteret kontrakt afslører en fejl under gennemgang, eller værre, efter underskrift, dokumenter hvad der skete. Hvilken prompt blev brugt? Hvilket gennemgangstrin missede fejlen? Hvad ville have fanget det tidligere? Disse lektioner, akkumuleret over tid, er hvad der forvandler en generisk AI-arbejdsgang til en firmaspesifik, kontinuerligt forbedret ansvarlig AI-udarbejdelsesperspektiv.

De teams, der springer obduktioner over, er dem, der gentager de samme fejl. De teams, der institutionaliserer dem, bygger en ægte konkurrencefordel inden for kvalitet og forsvarbarhed.

Udforsk ansvarlig, kildelinket AI-kontraktarbejdsgang

At anvende disse principper konsekvent kræver mere end gode intentioner. Det kræver en platform bygget til at understøtte dem.

Jarel er bygget specifikt til juridiske fagfolk, der har brug for AI-assistance, der forbliver forbundet til sine kilder. Hvert output i Jarels arbejdsrum er linket tilbage til det underliggende kontraktsprog, lov eller retspraksis, der informerede det, så din gennemgangsproces har noget konkret at verificere mod. Platformen inkluderer revisionslogger, adgangskontrol og gennemgangssti, der gør den type styret arbejdsgang, der er beskrevet i denne artikel, praktisk i stedet for teoretisk. For teams klar til at gå fra ad hoc AI-brug til en struktureret, compliant udarbejdelsesproces, giver Jarels ansvarlige AI-platform infrastrukturen til at gøre det rigtigt.

Ofte stillede spørgsmål

Hvad er den største risiko ved at bruge AI i kontraktudarbejdelse?

Den vigtigste risiko er at stole på AI-genereret indhold uden menneskelig verifikation, hvilket kan føre til hallucinererede citater eller faktiske fejl, der slipper ind i udførte kontrakter. NCSC beskriver hallucinationskategorier, herunder fabrikerede sagscitater, forvrængede holdninger, falsk proceduremæssig information og blandede juridiske begreber på tværs af jurisdiktioner.

Er advokater tilladt at bruge AI under ABA Model Rules?

Ja, advokater kan bruge AI, hvis de opretholder kompetence, fortrolighed, tilsyn og korrekt verifikation over arbejdsproduktet. ABA Formal Opinion 512 præsenterer generativ AI som en teknologi, som advokater skal bruge kompetent under eksisterende professionelle pligter.

Betyder AI-benchmarks, at menneskelig gennemgang er unødvendig?

Nej, selv top-performende AI-værktøjer kræver menneskelig verifikation, især for højrisiko-kontraktklausuler og citater. Empirisk benchmarking tyder på, at nogle AI-værktøjer kan matche eller overgå mennesker på begrænsede udarbejdelsesopgaver, men nøjagtighed er ikke perfekt, og risiko varierer betydeligt efter use case.

Hvilke kontraktbetingelser skal være i AI-leverandøraftaler?

Inkluder bestemmelser for datarettigheder, ansvarsfastsættelse, modeltrainingsbegrænsninger, revisionsevne og overholdelse af gældende regulatoriske rammer. Struktureret leverandørkontrakter med klausuleniveaustyring for disse spørgsmål er en anerkendt komponent af ansvarlig AI-brug i juridisk praksis.