Slik utarbeider du kontrakter ansvarlig med AI-assistanse

Juridiske team over hele landet oppdager en hard sannhet: AI-assistert kontraktutarbeiding kan kutte arbeidstimer til minutter, men en eneste uverifisert output kan introdusere feil som overlever helt til eksekusjon. Et internt team stolte nylig på et AI-verktøy for å generere en leverandøravtale, bare for å oppdage at skadeerstatningsklausulen siterte en lov som ikke eksisterte. Klausulen passerte to interne gjennomganger før en partner oppdaget det. Det scenarioet er ikke et unntak. Det er en forhåndsvisning av hva som skjer når hastighet overgår prosess.

Innholdsfortegnelse

- Forstå dine plikter: kompetanse, konfidensialitet og tilsyn

- Forberedelse: bygge en arbeidsflyt for ansvarlig AI-kontraktutarbeiding

- Kontraktutarbeidingsprosessen: ansvarlig AI-integrasjon steg for steg

- Feilsøking og risikomitigering: hallusinasjoner, kanttilfeller og etterlevelsessvikt

- Hvorfor det å behandle AI som assistent, ikke orakel, endrer resultater

- Utforsk ansvarlig, kildelenket AI-kontraktarbeidsflyt

- Ofte stilte spørsmål

Viktige takeaways

| Punkt | Detaljer | | --- | --- | | Menneskelig verifisering er essensielt | Behandle alltid AI-genererte utkast som uverifiserte inntil de er grundig gjennomgått av en juridisk ekspert. | | Forstå juridiske plikter | Advokater må anvende kompetanse, konfidensialitet og tilsyn når de integrerer AI-verktøy. | | Revidér og dokumentér arbeidsflyten | Oppretthold sporbare poster over AI-instruksjoner, gjennomganger og kontraktendringer for etterlevelse og forsvarbarhet. | | Målrette vanlige sviktpunkter | Fokuser gjennomgang på sitater, lover, jurisdiksjonsklausuler og mulige hallusinasjoner. | | Strukturerte kontrakter med AI-leverandører | Styr datakbruk, risiko og revisjonsrettigheter kontraktsmessig når du bruker AI-verktøy fra tredjeparter. |

Forstå dine plikter: kompetanse, konfidensialitet og tilsyn

Før noen AI-verktøy berører en kontrakt, må juridiske fagfolk være klare på hva faglig ansvar faktisk krever. Reglene har ikke blitt omskrevet for AI. De har blitt anvendt på det.

ABA Formal Opinion 512 rammer generativ AI som en teknologi advokater må bruke kompetent under eksisterende plikter, inkludert konfidensialitet, tilsyn og verifisering av arbeidsprodukter. Den rammingen betyr noe. Det betyr at advokaten som kjører en instruksjon og limer utdataene inn i et kontraktutkast fortsatt er fagpersonen som er ansvarlig for hvert ord i det dokumentet.

Kjernepliktene som gjelder når du bruker AI i kontraktutarbeiding inkluderer:

- Kompetanse: Du må forstå nok om hvordan AI-verktøyet fungerer til å identifisere når det sannsynligvis vil mislykkes, ikke bare når det lykkes.

- Konfidensialitet: Klientdata lastet opp til en AI-plattform fra tredjeparter kan bli beholdt, brukt til modelltreining eller utsatt for brudd. Konfidensialitetsplikten krever at du forstår disse risikoene før du legger inn noe som helst.

- Tilsyn: Hvis en junioradvokat eller juridisk assistent kjører AI-assisterte utkast, er den veiledende advokaten ansvarlig for utdataene som om de hadde skrevet det personlig.

- Verifisering: AI-generert tekst er et uverifisert utkast. Punktum. Det må behandles slik på hvert trinn.

"Advokater forblir ansvarlige for alt arbeidsprodukter, uavhengig av hvilket verktøy som brukes til å generere det. Generativ AI overfører eller svekker ikke faglig ansvar."

Å starte med en intern firmapolicy som koder disse pliktene inn i arbeidsflyten din er ikke valgfritt. Det er grunnlaget. Plattformer bygget rundt AI-utarbeidingsprinsipper kan hjelpe team med å operasjonalisere disse forpliktelsene i stedet for å la dem være abstrakte påminnelser på en etterlevelsessjekkliste.

Forberedelse: bygge en arbeitsflyt for ansvarlig AI-kontraktutarbeiding

Å kjenne dine plikter er utgangspunktet. Å bygge en arbeitsflyt som faktisk håndhever dem er det vanskeligere arbeidet. De fleste team som støter på problemer med AI-assistert utarbeiding mislykkes ikke fordi de ignorerte etikkkregler. De mislykkes fordi de aldri oversatte disse reglene til konkrete prosessteg.

En ansvarlig kontraktutarbeidingsarbeitsflyt bør operasjonalisere gjennomgangskontroller: behandle AI-tekst som uverifiserte utkast og kreve menneskelig verifisering før frigivelse eller avhengighet. Det er ikke et forslag. Det er minimumsstandarden for forsvarlig praksis.

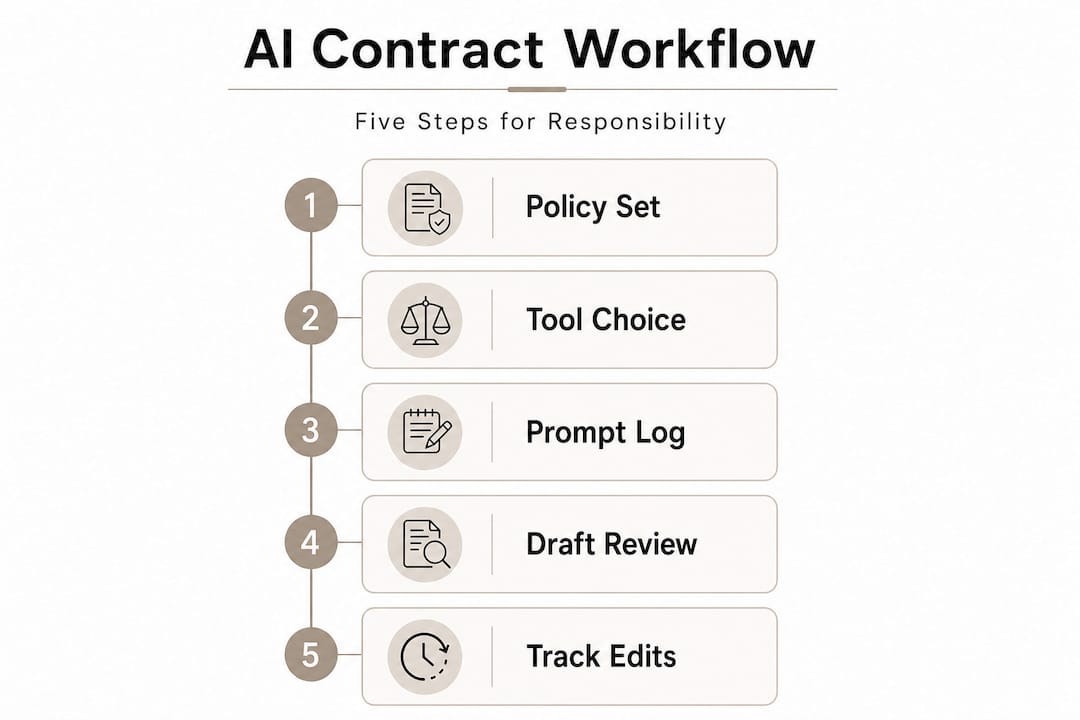

Før teamet ditt utarbeider en eneste AI-assistert kontrakt, arbeider du gjennom denne forberedelsessjekklisten:

- Policylaget: Utarbeid og vedta en intern AI-brukspolicy som spesifiserer hvilke verktøy som er godkjent, hvilke data som kan deles, og hvem som er autorisert til å bruke AI for hvilke oppgaver.

- Verktøyvalg: Velg plattformer som tilbyr kildesporingssporing, revisjonslogger, tilgangskontroller og klare dataoppbevaringspolicyer. Unngå verktøy som ikke kan fortelle deg hvor en klausul kommer fra.

- Leverandøravtaler: Ansvarlig bruk kan inkludere strukturert leverandørkontrakt og klausulenivåstyring for modelltreining, datarettigheter, ansvar og revisjonsbarhet. Hvis AI-leverandøravtalen din ikke adresserer disse punktene, forhandler du dem før du går live.

- Rolletildelinger: Utpek hvem som genererer AI-utkast, hvem som gjennomgår dem, og hvem som har endelig signaturmyndighet. Disse bør være forskjellige personer.

- Opplæring: Hvert teammedlem som bruker AI-verktøy bør forstå vanlige sviktmodi, spesielt hallusinasjoner, før de bruker plattformen på aktive saker.

Her er en praktisk oversikt over hvordan en styrt AI-utarbeidingsarbeitsflyt ser ut på tvers av nøkkeldimensjoner:

| Dimensjon | Hva som skal adresseres | Gjennomgangskontrollpunkt | |---|---|---| | Verktøyvalg | Kildesporingssporing, personvern, revisjonslogger | Før onboarding | | Instruksjondesign | Spesifisitet, jurisdiksjon, klausultype | Før generering | | Utdatagjennomgang | Nøyaktighet, sitater, juridisk passform | Etter generering | | Leverandøravtale | Datarettigheter, ansvar, modelltreining | Før kontraktsignering | | Revisjonspostaler | Instruksjoner, gjennomgangspersoner, resultater | Løpende |

ProfiTips: Oppretthold en løpende logg over hver AI-assistert kontraktoppgave, inkludert instruksjonen som ble brukt, gjennomgangspersonen som ble tildelt, og resultatet av verifikasjonskontrollen. Denne loggen er ditt beste forsvar hvis en klient eller regulator noen gang stiller spørsmål ved prosessen din. Det bygger også institusjonell kunnskap om hvilke instruksjonsmønstre som produserer pålitelige resultater og hvilke som trenger raffinering.

Å bygge AI-styring i juridiske arbeidsflyten fra bunnen av tar innsats, men det lønner seg første gang en kontrakttvist oppstår og du kan vise en klar, dokumentert kjede av menneskelig tilsyn.

Kontraktutarbeidingsprosessen: ansvarlig AI-integrasjon steg for steg

Forberedelsen er fullført. Nå begynner det faktiske utarbeidingsarbeidet. Trinnene nedenfor gjenspeiler en prosess som er både effektiv og forsvarlig. Å hoppe over trinn, spesielt verifikasjonsportene, er der team får problemer.

- Definer omfanget. Før du åpner noe AI-verktøy, dokumenter kontrakttypen, gjeldende lov, jurisdiksjon, nøkkelpartier og eventuelle ikke-standardbetingelser. Dette omfangsdokumentet blir grunnlaget for instruksjonen din og gjennomgangsjekklisten din.

- Velg en mal eller presedens. AI presterer bedre når det arbeider fra en kjent struktur. Start med en firmagodkjent mal eller en jurisdiksjonssspesifikk presedens. Fôr den konteksten inn i AI i stedet for å be den generere fra bunnen av.

- Utform en strukturert instruksjon. Spesifiser gjeldende lov, jurisdiksjon, klausultype og eventuelle spesifikke forpliktelser eller unntak. Vage instruksjoner produserer vage kontrakter.

- Generer utkastet. Kjør instruksjonen og fang hele utdataene, inkludert eventuelle kildesitater verktøyet gir. Ikke rediger ennå.

- Menneskelig gjennomgangskontroll. En kvalifisert gjennomgangsperson leser hele utkastet mot omfangsdokumentet. Dette er ikke en rask gjennomlesing. Det er en linje-for-linje gjennomgang med den opprinnelige malen åpen for sammenligning.

- Verifikasjonspass. Hver sitert lov, sak eller regulatorisk referanse blir uavhengig verifisert mot primærkilder. Hver jurisdiksjonsanspråk blir sjekket. Hvert definert begrep blir bekreftet for konsistens.

- Frigivelse eller retur for revisjon. Hvis utkastet passerer verifisering, beveger det seg fremover. Hvis det mislykkes, går det tilbake for målrettet revisjon, ikke en frisk AI-generering uten å forstå hva som gikk galt.

Empirisk benchmarking antyder at noen AI-verktøy kan matche eller overgå mennesker på begrenset utarbeidingsoppgaver, men menneskelig verifisering forblir nødvendig fordi nøyaktigheten ikke er perfekt og risiko varierer betydelig etter brukstilfelle. En høytytende AI på en standard NDA er ikke det samme som en høytytende AI på en grensekryssende oppkjøpsavtale med multi-jurisdiksjonsregulatoriske krumspring.

Her er hvordan de tre utarbeidingstilnærmingene sammenligner seg på tvers av nøkkelrisiko- og effektivitetsdimensjoner:

| Faktor | Manuell utarbeiding | AI-assistert, ingen verifisering | AI-assistert med verifisering | |---|---|---|---| | Hastighet | Langsom | Rask | Moderat | | Sitatkorrekthet | Høy | Variabel | Høy | | Hallusinasjonsrisiko | Ingen | Høy | Lav | | Forsvarbarhet | Høy | Lav | Høy | | Effektivitetsgevinst | Grunnlinje | Høy men risikabel | Betydelig og sikker |

Midtkolonnen er fellen. Team som adopterer AI for hastighet men hopper over verifisering får det verste fra begge verdener: raske utkast med skjulte feil og ingen revisjonssti for å vise at de sjekket.

ProfiTips: Bruk strukturerte instruksjoner som spesifiserer den nøyaktige klausultypen, gjeldende lov og eventuelle regulatoriske rammer som gjelder. For eksempel: "Utarbeid en ansvarsbegrensningsklausul styrt av New York-loven for en software-as-a-service-avtale mellom to kommersielle enheter, ekskludert følgeskader." Det nivået av spesifisitet produserer utdata som er langt lettere å verifisere mot en pålitelig kontraktutarbeidingsarbeitsflyt.

Feilsøking og risikomitigering: hallusinasjoner, kanttilfeller og etterlevelsessvikt

Selvom godt utformede arbeidsflyten møter problemer. Målet er ikke å eliminere all AI-feil, noe som ikke er mulig for øyeblikket. Målet er å fange feil før de betyr noe.

De vanligste sviktmodiene i AI-assistert kontraktutarbeiding inkluderer:

- Hallusinerte sitater: AI oppfinner en lov, sak eller regulatorisk referanse som ikke eksisterer eller siterer en virkelig kilde for et forslag som den faktisk ikke støtter.

- Blandede juridiske konsepter: AI fusjonerer standarder fra forskjellige jurisdiksjoner eller juridiske rammer, og produserer en klausul som ser sammenhengende ut men anvender den feil juridiske testen.

- Jurisdiksjonsusamsvar: AI anvender standardantagelser fra ett juridisk system (ofte føderalt eller common law) på en kontrakt som krever statsspesifikk eller sivilrettslig behandling.

- Utdatert autoritet: AI siterer en lov som har blitt endret eller en sak som har blitt omgjort, fordi treningsdataene har en avskjæringsdato.

- Inkonsistente definerte begreper: AI bruker samme begrep med litt forskjellige betydninger på tvers av forskjellige deler av samme kontrakt.

Kanttilfeller som vanligvis bryter AI-assistert utarbeiding inkluderer jurisdiksjonssspesifikke klausuler, sitatkorrekthet og hallusinert autoritet. Ansvarlige arbeidsflyten eksplisitt målretter disse sviktmodiene i stedet for å håpe de ikke vises.

"Aldri stol, alltid verifiser." NCSC AI Hallucination Guide identifiserer hallusinasjoner som fabrikerte sitater, forvrengte holdninger, falsk prosedyreinformasjon og blandede juridiske konsepter som kategorier som krever systematisk menneskelig verifisering, ikke stikkprøvekontroll.

For å revidere AI-genererte kontraktutdata effektivt, følg denne sekvensen:

Først kjører du hvert lovsitatat mot gjeldende versjon av den relevante koden. Anta ikke at AI har riktig seksjonnummer. For det andre verifiserer du hvert saksitatat ved å trekke den faktiske avgjørelsen og bekrefter proposisjonen AI tilskrev det. For det tredje sammenligner du jurisdiksjonsantagelser i utkastet mot den gjeldende lovklausulen. For det fjerde sjekker du definerte begreper for intern konsistens på tvers av hele dokumentet. For det femte flagg enhver klausul som gjennomgangspersonen ikke kan uavhengig verifisere mot en primærkilde.

ProfiTips: For sensitive saker, bevar instruksjonloggene og gjennomgangspostene som del av saksfilen. Hvis en kontrakt senere blir omtvistet og motpart stiller spørsmål ved om AI ble brukt ansvarlig, er revisjonsposten din beviset på at faglige standarder ble oppfylt. Dette er også god praksis for kontraktverifikasjonsstrategier som holder seg under regulatorisk gransking.

De juridiske og omdømmemessige risikoene ved uoppdagede feil er ikke hypotetiske. En fabrikert lov i en gjeldende lovklausul kan gjøre en bestemmelse ugjennomførbar. Et jurisdiksjonsusamsvar i en lovvalgsklausul kan utsette en klient for rettssak i et uventet forum. Dette er ikke kanttilfeller. De er de forutsigbare resultatene av å behandle AI-utdata som ferdig arbeid.

Hvorfor det å behandle AI som assistent, ikke orakel, endrer resultater

Her er den ubehagelige virkeligheten som de fleste AI-adopsjonssamtaler i juridisk praksis unngår: tilliten til AI-utdata er ikke korrelert med nøyaktigheten. Et AI-verktøy vil oppgi en fabrikert lov i nøyaktig samme tone og format som en virkelig. Det vil blande to inkompatible juridiske standarder uten noen indikasjon på at noe er galt. Den overflatetryggheten er den faktiske faren, ikke verktøyet selv.

En forsvarlig tilnærming er å behandle AI som en utarbeidingsassistent, ikke et juridisk orakel. Den rammingen krever kompetanse, konfidensialitet, tilsyn og verifikasjonsporter på hvert trinn av prosessen.

Den konvensjonelle visdommen i juridiske tech-kretser er at AI-adopsjonen primært er et endringsledelsesproblem. Få advokater komfortable med verktøyene, og resten følger. Den rammingen er galt på en spesifikk og viktig måte. Komfort med AI-verktøy uten strukturert verifisering er ikke fremgang. Det er risikoakkumulering i stor skala.

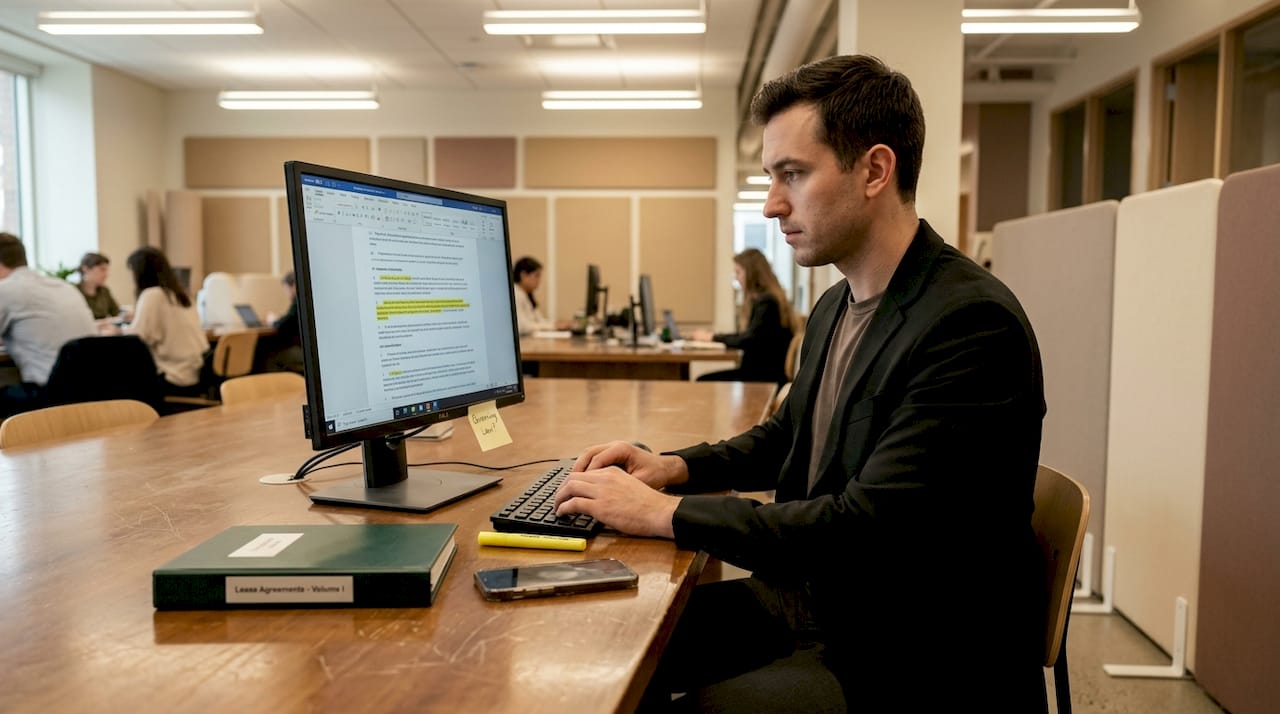

Teamet som får mest bærekraftig verdi fra AI-assistert utarbeiding er ikke de som bruker AI mest. De er de som har bygget de klareste prosessene for når de skal stole på AI-utdata og når de skal overstyre det. De behandler hvert AI-generert utkast som et utgangspunkt skrevet av en veldig rask, veldig sikker og av og til feil junioradvokat. Den mentale modellen holder advokaten i verifikasjonsrollen i stedet for den passive godkjenningsrollen.

En praktisk disiplin som er verdt å bygge inn i teamets kultur er kontraktobduksjonen. Når en AI-assistert kontrakt avslører en feil under gjennomgang, eller verre, etter eksekusjon, dokumenter hva som skjedde. Hvilken instruksjon ble brukt? Hvilket gjennomgangstrinn misset feilen? Hva ville ha fanget det tidligere? De leksjonene, akkumulert over tid, er det som gjør en generisk AI-arbeitsflyt til et firmaspesifikt, kontinuerlig forbedret ansvarlig AI-utarbeidingsperspektiv.

Teamet som hopper over obduksjoner er de som gjentar de samme feilene. Teamet som institusjonaliserer dem bygger et genuint konkurransefortrinn i kvalitet og forsvarbarhet.

Utforsk ansvarlig, kildelenket AI-kontraktarbeidsflyt

Å anvende disse prinsippene konsekvent krever mer enn gode intensjoner. Det krever en plattform bygget for å støtte dem.

Jarel er bygget spesifikt for juridiske fagfolk som trenger AI-assistanse som forblir forbundet til kildene. Hvert utdata i Jarels arbeidsrom er lenket tilbake til det underliggende kontraktspråket, loven eller rettspraksis som informerte det, slik at gjennomgangsprosessen din har noe konkret å verifisere mot. Plattformen inkluderer revisjonslogger, tilgangskontroller og gjennomgangssti som gjør den styrte arbeidsflyten beskrevet i denne artikkelen praktisk i stedet for teoretisk. For team som er klare til å gå fra ad hoc AI-bruk til en strukturert, kompatibel utarbeidingsprosess, gir Jarels ansvarlige AI-plattform infrastrukturen for å gjøre det riktig.

Ofte stilte spørsmål

Hva er den største risikoen ved å bruke AI i kontraktutarbeiding?

Hovedrisikoen er å stole på AI-generert innhold uten menneskelig verifisering, noe som kan føre til hallusinerte sitater eller faktiske feil som glir inn i utførte kontrakter. NCSC beskriver hallusinasjonskataloger inkludert fabrikerte sakssitater, forvrengte holdninger, falsk prosedyreinformasjon og blandede juridiske konsepter på tvers av jurisdiksjoner.

Er advokater tillatt å bruke AI under ABA Model Rules?

Ja, advokater kan bruke AI hvis de opprettholder kompetanse, konfidensialitet, tilsyn og riktig verifisering over arbeidsproduktet. ABA Formal Opinion 512 rammer generativ AI som en teknologi advokater må bruke kompetent under eksisterende faglige plikter.

Betyr AI-benchmarks at menneskelig gjennomgang er unødvendig?

Nei, selv toppytende AI-verktøy krever menneskelig verifisering, spesielt for høyrisikokontraktklausuler og sitater. Empirisk benchmarking antyder at noen AI-verktøy kan matche eller overgå mennesker på begrenset utarbeidingsoppgaver, men nøyaktigheten er ikke perfekt og risiko varierer betydelig etter brukstilfelle.

Hvilke kontraktbetingelser bør være i AI-leverandøravtaler?

Inkluder bestemmelser for datarettigheter, ansvarsfordeling, modelltreningsbegrensninger, revisjonsbarhet og etterlevelse av gjeldende regulatoriske rammer. Strukturert leverandørkontrakt med klausulenivåstyring for disse problemene er en anerkjent komponent av ansvarlig AI-bruk i juridisk praksis.