Så utformar du avtal ansvarsfullt med AI-stöd

Juristteam över hela landet upptäcker en obekväm sanning: AI-stödd avtalsutformning kan reducera timmar av arbete till minuter, men ett enda overifierat resultat kan föra in fel som överlever ända fram till underskrift. Ett internt juristteam förlitade sig nyligen på ett AI-verktyg för att generera ett leverantörsavtal, bara för att upptäcka att indemnitetsklausulen hänvisade till en lag som inte fanns. Klausulen passerade två interna granskningar innan en delägare upptäckte felet. Det scenariot är inget undantag. Det är en försmak av vad som händer när tempot springer ifrån processen.

Innehållsförteckning

- Förstå dina skyldigheter: kompetens, sekretess och tillsyn

- Förberedelse: bygga ett arbetsflöde för ansvarsfull AI-baserad avtalsutformning

- Avtalsutformningen: ansvarsfull AI-integration steg för steg

- Felsökning och hantering av vanliga risker: hallucinationer, gränsfall och bristande efterlevnad

- Varför det förändrar resultatet att behandla AI som ett hjälpmedel, inte ett orakel

- Utforska ansvarsfulla, källänkade AI-avtalsflöden

- Vanliga frågor

Viktiga lärdomar

| Punkt | Detaljer | | --- | --- | | Mänsklig verifiering är avgörande | Behandla alltid AI-genererade utkast som overifierade tills de granskats noggrant av en juridisk expert. | | Förstå juridiska skyldigheter | Jurister måste tillämpa kompetens, sekretess och tillsyn när de integrerar AI-verktyg. | | Granska och dokumentera arbetsflöden | För spårbara register över AI-prompter, granskare och avtalsändringar för efterlevnad och försvarbarhet. | | Rikta in dig på vanliga felpunkter | Fokusera granskningen på källhänvisningar, lagrum, jurisdiktionsklausuler och möjliga hallucinationer. | | Strukturerade avtal med AI-leverantörer | Reglera dataanvändning, risk och granskningsrätt avtalsmässigt vid användning av AI-verktyg från tredje part. |

Förstå dina skyldigheter: kompetens, sekretess och tillsyn

Innan något AI-verktyg får komma nära ett avtal måste juristen ha klart för sig vad professionellt ansvar faktiskt innebär. Reglerna har inte skrivits om för AI. De har tillämpats på AI.

ABA Formal Opinion 512 ramar in generativ AI som en teknik som jurister måste använda kompetent inom ramen för befintliga skyldigheter, inklusive sekretess, tillsyn och verifiering av arbetsresultat. Den utgångspunkten är viktig. Den innebär att juristen som kör en prompt och klistrar in resultatet i ett avtalsutkast fortfarande är den professionella som ansvarar för varje ord i dokumentet.

De grundläggande skyldigheterna som gäller vid användning av AI i avtalsutformning omfattar:

- Kompetens: Du måste förstå tillräckligt om hur AI-verktyget fungerar för att kunna identifiera när det sannolikt brister, inte bara när det fungerar.

- Sekretess: Klientdata som laddas upp till en tredjeparts AI-plattform kan sparas, användas för modellträning eller exponeras vid intrång. Sekretessplikten kräver att du förstår dessa risker innan du matar in något.

- Tillsyn: Om en yngre medarbetare eller paralegal kör AI-stödda utkast är den ansvariga juristen ansvarig för resultatet som om hen själv hade skrivit det.

- Verifiering: AI-genererad text är ett overifierat utkast. Punkt. Den måste behandlas så i varje skede.

"Jurister förblir ansvariga för allt arbetsresultat, oavsett vilket verktyg som används för att skapa det. Generativ AI överför eller späder inte ut det professionella ansvaret."

Att börja med en tydlig intern policy som omsätter dessa skyldigheter i ert arbetsflöde är inte valfritt. Det är grunden. Plattformar som bygger på AI-utformningsprinciper kan hjälpa team att operationalisera dessa skyldigheter snarare än att lämna dem som abstrakta påminnelser på en compliance-checklista.

Förberedelse: bygga ett arbetsflöde för ansvarsfull AI-baserad avtalsutformning

Att känna till sina skyldigheter är utgångspunkten. Att bygga ett arbetsflöde som faktiskt upprätthåller dem är det svårare arbetet. De flesta team som råkar i trubbel med AI-stödd utformning misslyckas inte för att de struntade i etiska regler. De misslyckas för att de aldrig översatte reglerna till konkreta processteg.

Ett ansvarsfullt arbetsflöde för avtalsutformning bör operationalisera granskningsgrindar: behandla AI-text som overifierade utkast och kräva mänsklig verifiering innan dokumentet släpps eller används som underlag. Det är inte ett förslag. Det är minimistandarden för försvarbar yrkesutövning.

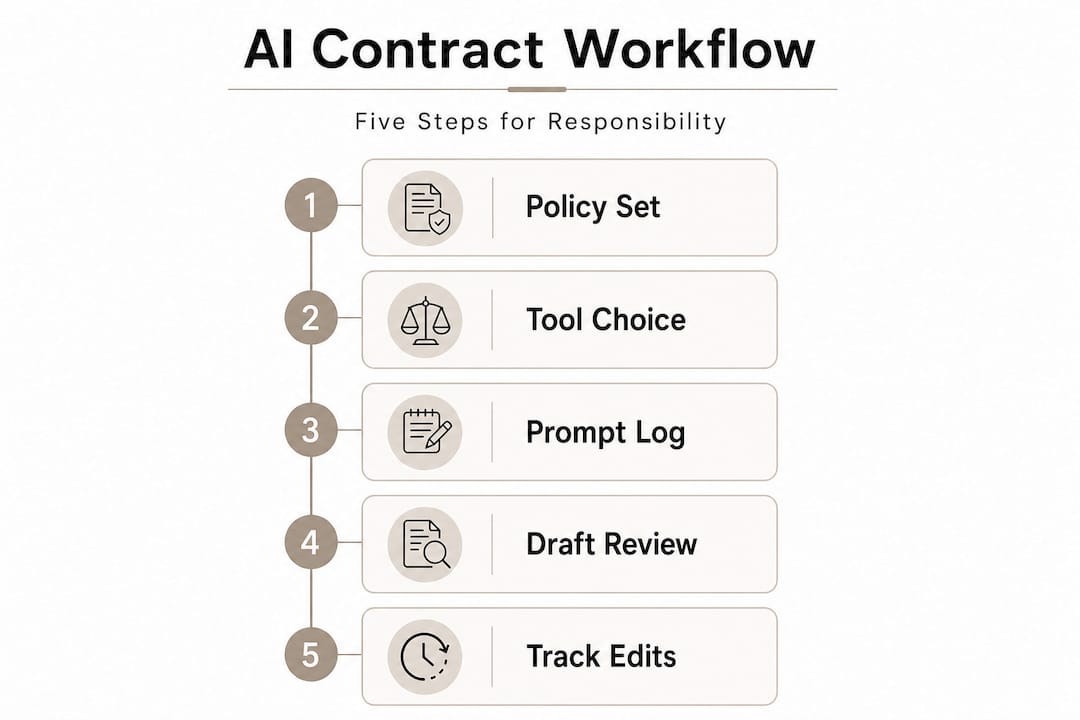

Innan ditt team utformar ett enda AI-stött avtal, gå igenom denna förberedelsechecklista:

- Policynivå: Utforma och anta en intern AI-användningspolicy som specificerar vilka verktyg som är godkända, vilka data som får delas och vem som är behörig att använda AI för vilka uppgifter.

- Verktygsval: Välj plattformar som erbjuder källspårning, granskningsloggar, åtkomstkontroller och tydliga policyer för datalagring. Undvik verktyg som inte kan tala om var en klausul kommer ifrån.

- Leverantörsavtal: Ansvarsfull användning kan omfatta strukturerad leverantörskontraktering och styrning på klausulnivå för modellträning, datarättigheter, ansvar och granskningsbarhet. Om ert AI-leverantörsavtal inte adresserar dessa punkter, förhandla in dem innan ni går live.

- Rolltilldelning: Utse vem som genererar AI-utkast, vem som granskar dem och vem som har slutligt godkännandeansvar. Detta bör vara olika personer.

- Utbildning: Varje teammedlem som använder AI-verktyg bör förstå vanliga felmoder, särskilt hallucinationer, innan de använder plattformen i skarpa ärenden.

Här är en praktisk översikt över hur ett styrt AI-arbetsflöde ser ut längs centrala dimensioner:

| Dimension | Vad ska adresseras | Granskningspunkt | |---|---|---| | Verktygsval | Källspårning, integritet, granskningsloggar | Före onboarding | | Promptdesign | Specificitet, jurisdiktion, klausultyp | Före generering | | Resultatgranskning | Korrekthet, källhänvisningar, juridisk relevans | Efter generering | | Leverantörsavtal | Datarättigheter, ansvar, modellträning | Före avtalstecknande | | Granskningsregister | Prompter, granskare, utfall | Löpande |

Tips: För en löpande logg över varje AI-stödd avtalsuppgift, inklusive vilken prompt som användes, vilken granskare som tilldelades och utfallet av verifieringen. Den loggen är ditt bästa försvar om en klient eller tillsynsmyndighet någonsin ifrågasätter er process. Den bygger också upp institutionell kunskap om vilka promptmönster som ger pålitliga resultat och vilka som behöver justeras.

Att bygga AI-styrning i juridiska arbetsflöden från grunden kräver arbete, men det betalar sig första gången en avtalstvist uppstår och du kan visa en tydlig, dokumenterad kedja av mänsklig översyn.

Avtalsutformningen: ansvarsfull AI-integration steg för steg

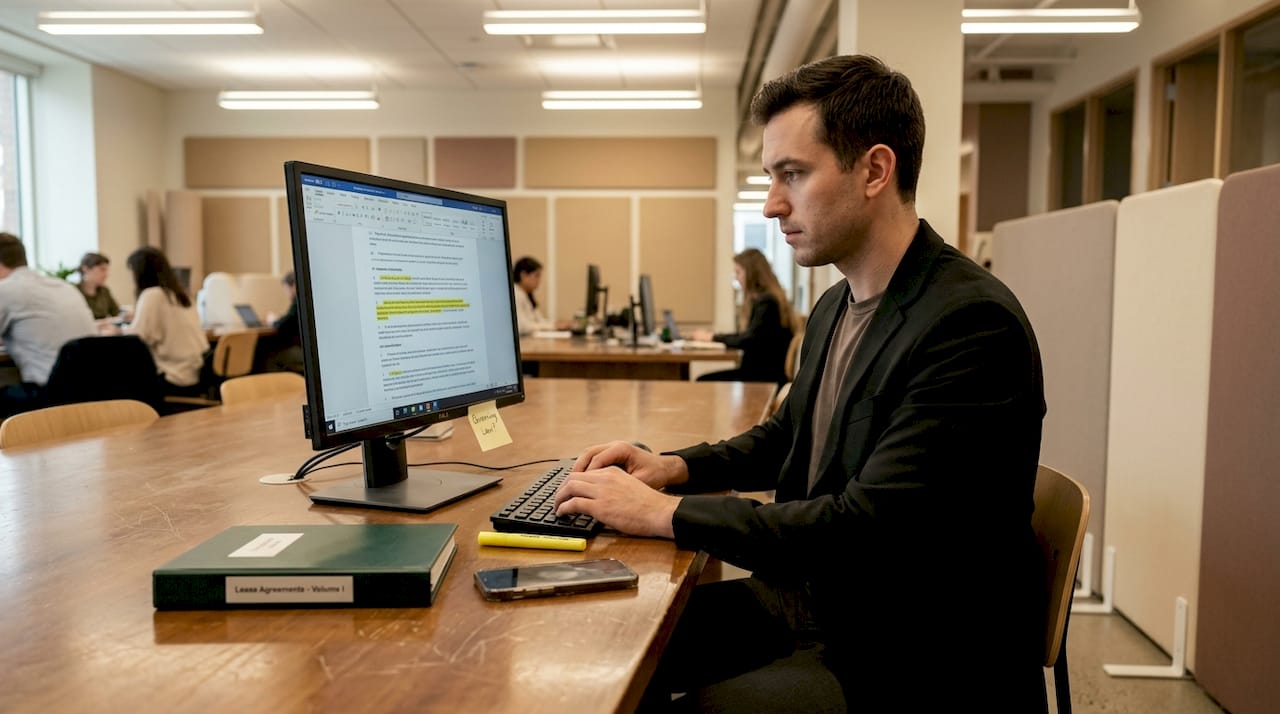

Förberedelsen är klar. Nu börjar själva utformningsarbetet. Stegen nedan speglar en process som är både effektiv och försvarbar. Att hoppa över steg, särskilt verifieringsgrindarna, är där team hamnar i trubbel.

- Definiera omfattningen. Innan du öppnar något AI-verktyg, dokumentera avtalstyp, tillämplig lag, jurisdiktion, viktiga parter och eventuella icke-standardiserade villkor. Detta omfångsdokument blir grunden för din prompt och din granskningschecklista.

- Välj en mall eller ett prejudikat. AI presterar bättre när den arbetar utifrån en känd struktur. Börja med en byråinternt godkänd mall eller ett jurisdiktionsspecifikt prejudikat. Mata in den kontexten i AI:n istället för att be den generera från grunden.

- Formulera en strukturerad prompt. Specificera tillämplig lag, jurisdiktion, klausultyp och eventuella specifika skyldigheter eller undantag. Vaga prompter ger vaga avtal.

- Generera utkastet. Kör prompten och fånga hela resultatet, inklusive alla källhänvisningar verktyget tillhandahåller. Redigera inte ännu.

- Mänsklig granskningsgrind. En kvalificerad granskare läser hela utkastet mot omfångsdokumentet. Detta är ingen översiktlig läsning. Det är en rad-för-rad-granskning med originalmallen öppen för jämförelse.

- Verifieringsomgång. Varje åberopad lag, rättsfall eller regulatorisk hänvisning verifieras självständigt mot primärkällor. Varje jurisdiktionspåstående kontrolleras. Varje definierat begrepp bekräftas för konsistens.

- Släpp eller skicka tillbaka för revidering. Om utkastet klarar verifieringen går det vidare. Om det inte klarar går det tillbaka för riktad revidering, inte en ny AI-generering utan att förstå vad som gick fel.

Empirisk benchmarking tyder på att vissa AI-verktyg kan matcha eller överträffa människor på begränsade utformningsuppgifter, men mänsklig verifiering förblir nödvändig eftersom precisionen inte är perfekt och risken varierar betydligt mellan användningsområden. En högpresterande AI på en standard-NDA är inte detsamma som en högpresterande AI på ett gränsöverskridande förvärvsavtal med multijurisdiktionella regulatoriska hakar.

Så här jämförs de tre utformningsstrategierna längs viktiga risk- och effektivitetsdimensioner:

| Faktor | Manuell utformning | AI-stödd, utan verifiering | AI-stödd med verifiering | |---|---|---|---| | Hastighet | Långsam | Snabb | Måttlig | | Källhänvisningarnas korrekthet | Hög | Varierande | Hög | | Risk för hallucinationer | Ingen | Hög | Låg | | Försvarbarhet | Hög | Låg | Hög | | Effektivitetsvinst | Baslinje | Hög men riskabel | Betydande och säker |

Mittenkolumnen är fällan. Team som tar in AI för hastighetens skull men hoppar över verifiering får det sämsta av två världar: snabba utkast med dolda fel och inget granskningsspår som visar att de kontrollerade.

Tips: Använd strukturerade prompter som specificerar exakt klausultyp, tillämplig lag och eventuellt regulatoriskt ramverk som gäller. Till exempel: "Utforma en ansvarsbegränsningsklausul som regleras av delstaten New Yorks lag för ett SaaS-avtal mellan två kommersiella enheter, med uteslutande av följdskador." Den graden av specificitet ger resultat som är betydligt enklare att verifiera mot ett tillförlitligt arbetsflöde för avtalsutformning.

Felsökning och hantering av vanliga risker: hallucinationer, gränsfall och bristande efterlevnad

Även välutformade arbetsflöden stöter på problem. Målet är inte att eliminera alla AI-fel, vilket inte är möjligt idag. Målet är att fånga upp fel innan de får betydelse.

De vanligaste felmoderna i AI-stödd avtalsutformning omfattar:

- Hallucinerade källhänvisningar: AI:n hittar på en lag, ett rättsfall eller en regulatorisk hänvisning som inte finns, eller hänvisar till en verklig källa för ett påstående den faktiskt inte stödjer.

- Sammanblandade rättsbegrepp: AI:n slår ihop standarder från olika jurisdiktioner eller rättsliga ramverk och producerar en klausul som ser sammanhängande ut men tillämpar fel rättslig prövning.

- Jurisdiktionsmissmatchning: AI:n tillämpar standardantaganden från ett rättssystem (ofta federalt eller common law) på ett avtal som kräver delstatsspecifik eller civilrättslig behandling.

- Föråldrad rättskälla: AI:n hänvisar till en lag som har ändrats eller ett rättsfall som har upphävts, eftersom dess träningsdata har ett brytdatum.

- Inkonsekventa definierade begrepp: AI:n använder samma begrepp med något olika innebörd i olika sektioner av samma avtal.

Gränsfall som vanligen får AI-stödd utformning att haverera inkluderar jurisdiktionsspecifika klausuler, källhänvisningarnas korrekthet och hallucinerade rättskällor. Ansvarsfulla arbetsflöden riktar sig uttryckligen mot dessa felmoder snarare än att hoppas att de inte ska dyka upp.

"Lita aldrig, verifiera alltid." NCSC AI Hallucination Guide identifierar hallucinationer som påhittade rättsfallshänvisningar, förvrängda domslut, falsk processuell information och sammanblandade rättsbegrepp som kategorier som kräver systematisk mänsklig verifiering, inte stickprov.

För att granska AI-genererade avtalsresultat effektivt, följ denna sekvens:

För det första, kör varje lagrumshänvisning mot den aktuella versionen av relevant kod. Anta inte att AI:n har rätt paragrafnummer. För det andra, verifiera varje rättsfallshänvisning genom att ta fram det faktiska avgörandet och bekräfta det påstående som AI:n tillskrev det. För det tredje, jämför jurisdiktionsantaganden i utkastet mot lagvalsklausulen. För det fjärde, kontrollera definierade begrepp för intern konsistens i hela dokumentet. För det femte, flagga varje klausul som granskaren inte självständigt kan verifiera mot en primärkälla.

Tips: För känsliga ärenden, bevara dina promptloggar och granskningsregister som en del av ärendeakten. Om ett avtal senare bestrids och motpartsadvokat ifrågasätter om AI användes ansvarsfullt, är ditt granskningsspår beviset på att professionella standarder uppfylldes. Det är också god praxis för avtalsverifieringsstrategier som håller under regulatorisk granskning.

De juridiska och anseenderelaterade riskerna med missade fel är inte hypotetiska. En påhittad lag i en lagvalsklausul kan göra en bestämmelse omöjlig att verkställa. En jurisdiktionsmissmatchning i en lagvalsklausul kan utsätta en klient för rättstvist i ett oväntat forum. Det är inga gränsfall. De är de förutsägbara följderna av att behandla AI-resultat som färdigt arbete.

Varför det förändrar resultatet att behandla AI som ett hjälpmedel, inte ett orakel

Här är den obekväma verkligheten som de flesta samtal om AI-anammande inom juristbranschen undviker: tillförsikten i AI-resultatet är inte korrelerad med dess korrekthet. Ett AI-verktyg uppger en påhittad lag i exakt samma ton och format som en verklig. Det blandar två oförenliga rättsliga standarder utan att antyda att något är fel. Den ytliga säkerheten är den faktiska faran, inte verktyget i sig.

Ett försvarbart förhållningssätt är att behandla AI som ett utformningsstöd, inte ett juridiskt orakel. Den utgångspunkten kräver kompetens, sekretess, tillsyn och verifieringsgrindar i varje skede av processen.

Den vedertagna sanningen i legal tech-kretsar är att AI-anammande primärt är ett förändringsledningsproblem. Få jurister att känna sig bekväma med verktygen, så följer resten. Den utgångspunkten är fel på ett specifikt och viktigt sätt. Bekvämlighet med AI-verktyg utan strukturerad verifiering är inte framsteg. Det är riskackumulering i stor skala.

De team som får mest hållbart värde av AI-stödd utformning är inte de som använder AI mest. Det är de som har byggt de tydligaste processerna för när man ska lita på AI-resultat och när man ska åsidosätta det. De behandlar varje AI-genererat utkast som en utgångspunkt skriven av en mycket snabb, mycket självsäker och ibland fel ute juniormedarbetare. Den mentala modellen håller juristen i verifieringsrollen snarare än i den passiva godkännanderollen.

En praktisk disciplin värd att bygga in i ert teams kultur är avtalspostmortem. När ett AI-stött avtal avslöjar ett fel under granskningen, eller värre, efter underskrift, dokumentera vad som hände. Vilken prompt användes? Vilket granskningssteg missade felet? Vad hade fångat upp det tidigare? De lärdomarna, ackumulerade över tid, är vad som förvandlar ett generiskt AI-arbetsflöde till ett byråspecifikt, kontinuerligt förbättrat ansvarsfullt AI-utformningsperspektiv.

Teamen som hoppar över postmortems är de som upprepar samma fel. Teamen som institutionaliserar dem bygger en genuin konkurrensfördel i kvalitet och försvarbarhet.

Utforska ansvarsfulla, källänkade AI-avtalsflöden

Att tillämpa dessa principer konsekvent kräver mer än goda intentioner. Det kräver en plattform byggd för att stödja dem.

Jarel är byggd specifikt för juridiska yrkesutövare som behöver AI-stöd som hela tiden är kopplat till sina källor. Varje resultat i Jarels arbetsyta länkas tillbaka till den underliggande avtalstexten, lagstiftningen eller rättspraxis som gav upphov till det, så att din granskningsprocess har något konkret att verifiera mot. Plattformen inkluderar granskningsloggar, åtkomstkontroller och granskningsspår som gör den typ av styrt arbetsflöde som beskrivs i denna artikel praktiskt genomförbar snarare än teoretisk. För team som är redo att gå från ad hoc-användning av AI till en strukturerad, regelefterlevande utformningsprocess tillhandahåller Jarels ansvarsfulla AI-plattform infrastrukturen för att göra det rätt.

Vanliga frågor

Vilken är den största risken med att använda AI i avtalsutformning?

Den största risken är att förlita sig på AI-genererat innehåll utan mänsklig verifiering, vilket kan leda till att hallucinerade källhänvisningar eller faktafel slinker in i undertecknade avtal. NCSC beskriver kategorier av hallucinationer som påhittade rättsfallshänvisningar, förvrängda domslut, falsk processuell information och sammanblandade rättsbegrepp över jurisdiktioner.

Får jurister använda AI enligt ABA Model Rules?

Ja, jurister får använda AI om de upprätthåller kompetens, sekretess, tillsyn och korrekt verifiering av arbetsresultatet. ABA Formal Opinion 512 ramar in generativ AI som en teknik som jurister måste använda kompetent inom ramen för befintliga professionella skyldigheter.

Innebär AI-benchmarkar att mänsklig granskning är onödig?

Nej, även toppresterande AI-verktyg kräver mänsklig verifiering, särskilt för högriskklausuler och källhänvisningar i avtal. Empirisk benchmarking tyder på att vissa AI-verktyg kan matcha eller överträffa människor på begränsade utformningsuppgifter, men korrektheten är inte perfekt och risken varierar betydligt mellan användningsområden.

Vilka avtalsvillkor bör finnas i avtal med AI-leverantörer?

Inkludera bestämmelser om datarättigheter, ansvarsfördelning, restriktioner för modellträning, granskningsbarhet och efterlevnad av tillämpliga regulatoriska ramverk. Strukturerad leverantörskontraktering med styrning på klausulnivå för dessa frågor är en erkänd komponent i ansvarsfull AI-användning inom juridisk praktik.